▼

在过去两年,所有业内人都在谈「AI 时代的产品经理到底什么样?」或「AI 时代还需要招一个产品经理吗?」。技术的发展模糊了岗位的分工,尤其在这一轮 AI 创业,固有的产品经验几乎失效。

被陆奇在奇绩内部多次称赞「最像硅谷产品经理」的张浩然。他做了十年生产力工具,如今正在探索一款企业级的多智能体产品。

他从传统 RAG、流程编排,到进入 AI时代后,一路将之迭代到复杂的 Agent 生态,中间重写过无数次架构,也踩过足够多坑,整个产品的底层思维也被重构了一遍。

他总结出了AI 时代,一个产品人必须拥有的四大核心能力。

• 从流程 →到定义目标和边界

• 从场景 →到抽象模式和原子能力

• 从单 Agent→到可自治、多Agent协同的生态系统

• 从对/错 →到性能区间与评估体系

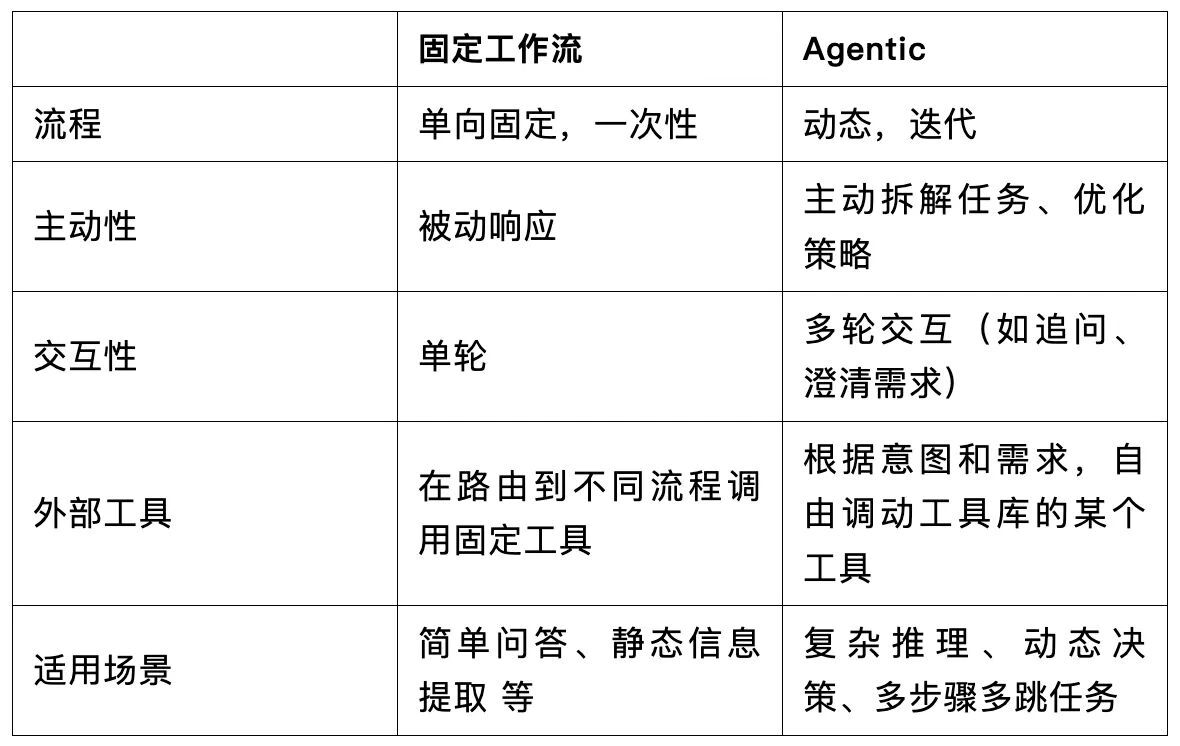

传统的软件时代,产品人对应的工作流一切都是确定的:逻辑是明确的;界面是静态的;用户行为遵循稳定路径。

产品人的工作是提需,写流程,交给开发,然后用户照着走。

但 AI 的本质是概率分布,是语言、是推理、是涌现,是极度不稳定的。

产品人根本无法设计一个「确定性」的 AI系统。因为用户每次问的问题都不同,即便问一样的问题,也可能处在不同的语境/

因此,用固定的框架框住工作流往往会限制住 AI自学习的能力,现阶段应该最先定义产品的目标和边界:

1、这个 Agent 负责的业务目标是什么?

2、哪些事情不做?

张浩然在文章中举了一个例子。

2023年之前,企业内部的AI客服机器人大多遵从固定框架。输入想法,AI基于特定的工作流,拆解任务,搜索信息RAG返回,最终跑出结果。在特定的单一场景领域,这类产品是奏效的,但场景一旦扩展,马上就会发现这个架构的局限性。

比如一个用户问:我想退回上个月购买的无线耳机,但我丢失了收据。我还保留着原包装,订单号是A12345。

传统的RAG检索很难理解其中复杂因素间的关系。进入AI时代,产品人处理这个问题首先要确定边界。

张浩然又举了一例子,比如用户问:下周回北京,帮我约一下 DK和 XY的时间,避免我遗忘,在飞书里给我创建个提醒。首先要理解,用户在北京开会,但边界是模糊的,产品要通过多轮对话确定:具体哪天开。

用户:「周三下午见,大概 3点左右。可以在三里屯的星巴克见面。」

到这里,已有了丰富信息,AI就可以拆解目标了。

传统软件时代,产品人最爱做的是通过用户访谈,然后加功能。

但在AI时代,用户和产品之间的交互大多使用自然语言,用户表面上说,我希望你帮我查看历史订单,但背后也许对应的100种不同的需求:也许是想开发票,也许是想看下最近的生活支出,也许是想复购。

一个产品人不应该也没有能力为每一种表达创造一个功能,所以,这就要求必须具备高度的抽象能力

张浩然总结三种能力:

1、模式识别能力:识别多样化表达中的用户需求

2、意图映射:理解用户表达类似需求的各种方式

3、 边界定义:明确区分 AI责任范围内外的事项

他举了一个经典区别,用户希望查询订单:传统产品人下达的需求:增加一个重新订购按钮。AI产品人会让Agent理解并执行用户在任何对话上下文中重复过往购买的意图。

步骤应该是是澄清(Clarification)—补全信息(Information Gathering)——任务分解(Task Decomposition)——工具选择(Tool Routing)——最后执行。

也就是任何时候,只要用户提到过去买过什么、想再买什么,都要启动『复购 agent』这条链路。

换言之,抽象不是写概念,是把同一类问题归到同一条链路上。

AI时代的产品人不能再用线性思维拆解用户意图,以单一用户案例简单造轮子,而是要抽象出稳定、可复用的模式

一个优秀的AI产品人绝不应该关心怎么做,而是应该去定义「系统应该掌握哪些能力去应付所有变体」。

为系统加能力,而不是功能,这就是从「具体」到「抽象」的本质跨越。

传统软件时代,产品人验证一个系统是否正常工作,只需要判断功能是否按照预期输出即可——这是一个明确的二元逻辑:对 /错、可用 /不可用、通过/不通过。

但张浩然认为,当系统演化为由大模型驱动的 Agentic系统后,这种思维模式彻底失效了,因为AI的输出天然具有概率性、连续性、上下文依赖性以及涌现性。「AI系统的质量表现存在于一个连续谱系,而不是简单的二选一判断。」

这意味着 AI产品人不能再依赖「场景验收」或「功能走查」,而必须构建一整套「性能区间管理体系」。

这包括以下更复杂的测试问题:

• 在 100个真实样本里,系统的平均表现是什么?

• 哪些子类别错误频率最高?

• 是否需要触发反思循环?

• 哪些任务应被转入人工审核?

• 哪些场景需要修改prompt或智能体结构?

• 哪些失败源于工具调用失败?

张浩然举例:在用户想退货的例子中,传统 RAG范式会一次性塞入大量信息,导致模型在有限的上下文里出现「相关性稀释」而无法给出答案。这种产品 BUG不是功能性的,而应该叫「性能退化」。

信息被淹没,导致输出变得模糊、不精确。评估这种问题不能靠一次测试,而必须通过「批量样本评估」,体现系统在不同表述上的稳定性。

AI 产品人的职责不再是「验收功能」,而是管理「性能区间」。这需要构建单样本测试(Unit Test)、评估集(EvalSet)、批量评测(BatchEvaluate)与漂移监控(Drift Monitor),并将结果反向作用于 prompt、智能体拓扑、工具链调度和记忆系统的设计中。

进入 2025年后,传统的单轮 RAG和线性 LLM workflow已经无法支撑真实世界的问题复杂度,现在公认的主流框架是建立一个一个多模型、多智能体(multi-agent)、工具链式动作(tool-using)的系统。尤其现在用户对AI的需求已经提高到——要求AI更接近一个真实的员工——Manus今年的火爆就验证了这一点。

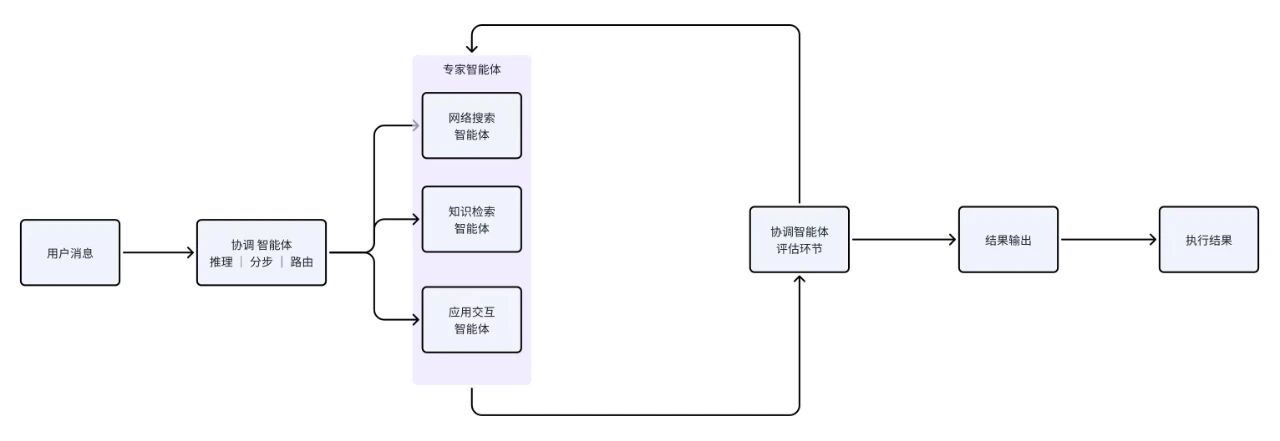

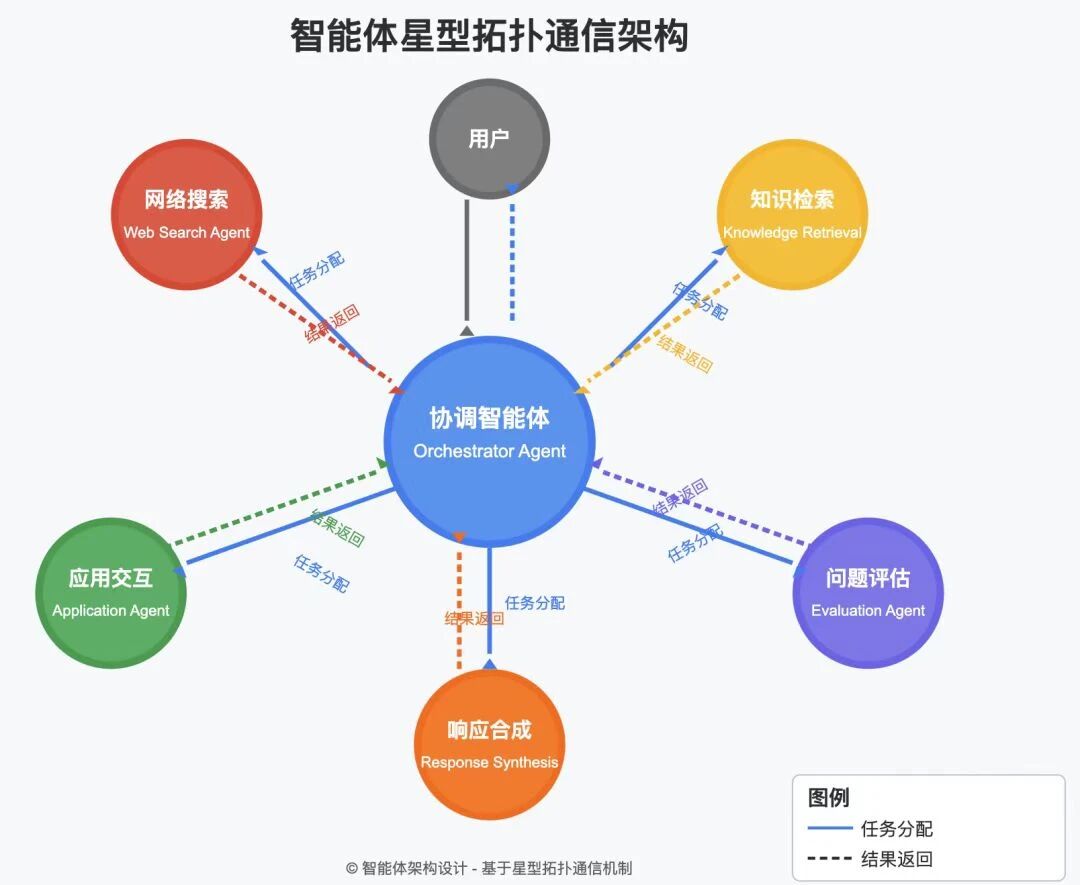

张浩然认为,构建这样的协同,需要产品人理解多 Agent如何互相协作来完成复杂度更高的任务,也就是说,AI产品人需要设计一个「可自治、可协作、可反思」的生态系统。

这个生态系统的关键能力如下,也可以理解为每个能力对应一个Agent

1、意图理解

协调智能体(Orchestrator)负责理解意图、补齐需求、规划任务、调度其他 Agent,是整个系统的大脑,也是AI产品人最需要定义边界与目标的部分 。

2、专业能力

专家智能体(Specialist Agents):千行百业各有不同,要构建行业 know—how能力,通过网络搜索、知识检索、App API调用智能体,各自承担不同能力,形成模块化能力网络 。

3、评估

评估智能体(Evaluator):用于判断结果是否满足目标、是否需要重试、是否需要进一步检索。这在概率性系统中尤为关键。

4、长记忆

负责短期、中期、长期记忆,构建真正的个性化体验;否则系统无法在跨时段任务中保持上下文连贯性。

为了让这些能力(Agent)能协作,AI时代的产品人还必须能理解拓扑选用星型、链型还是消息池,然后不断评估性能、边界与协作方式。

张浩然最新的思考是,如果未来用户用自然语言希望完成一个复杂的任务,那么必然Agent需要调用各种不同的工具,那么如何构建一个Agentic去理解用户的业务,从而把工具调得更准。

这是是一整套复杂的AI的system的体系。过去的产品人只需要定义一个工作流,然后交给后端、前端。

现在,一个合格的产品人需要把自己硬生生练成一个全栈 AI builder。

—最后,我们引用张浩然原文的结尾—

「不是所有能被计算的都有价值,也不是所有有价值的都能被计算。」爱因斯坦的这句名言,或许是我们面对 AI产品范式转变最恰当的启示。

传统软件世界中,我们习惯于线性思维、确定性假设和可预测的结果。我们用流程图描绘用户旅程,用功能清单定义产品边界。这种方法在确定性系统中运作良好,就像牛顿力学在中等尺度世界的精确预测一样。

然而,随着人工智能带来的范式转变,我们进入了一个全新的认知领域这里的规则更像量子力学,充满了概率、不确定性和涌现属性。

在这个领域中,产品不再是静态的工具,而是与人类共舞的动态伙伴。

正如物理学家尼尔斯·玻尔所言:「如果量子力学没有让你感到震惊,那说明你还没有理解它。」

同样,如果 AI产品的新范式没有让我们重新思考产品的本质,那我们可能仍停留在旧世界的认知框架中。

图片来源|unsplash、分享人供图

推荐活动