3.1 V1.0版本:Prompt 工程探索阶段

核心假设:大模型已具备足够的“测试常识”,只需通过精心设计的 Prompt 引导,即可生成高质量测试用例。

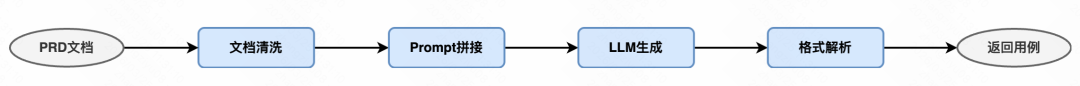

技术方案:V1.0 单体生成流程

3.1.2 核心技术实现

技术架构

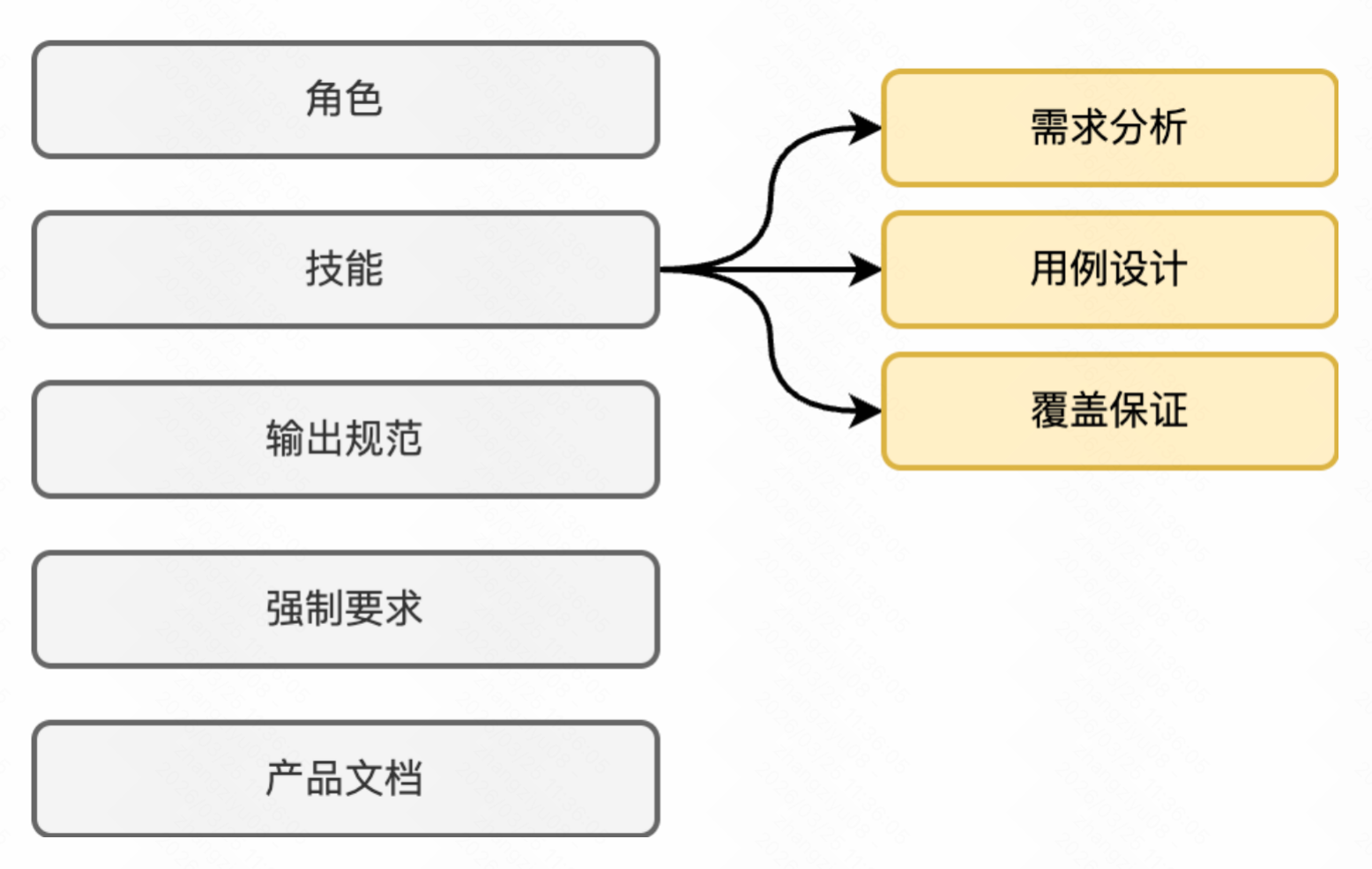

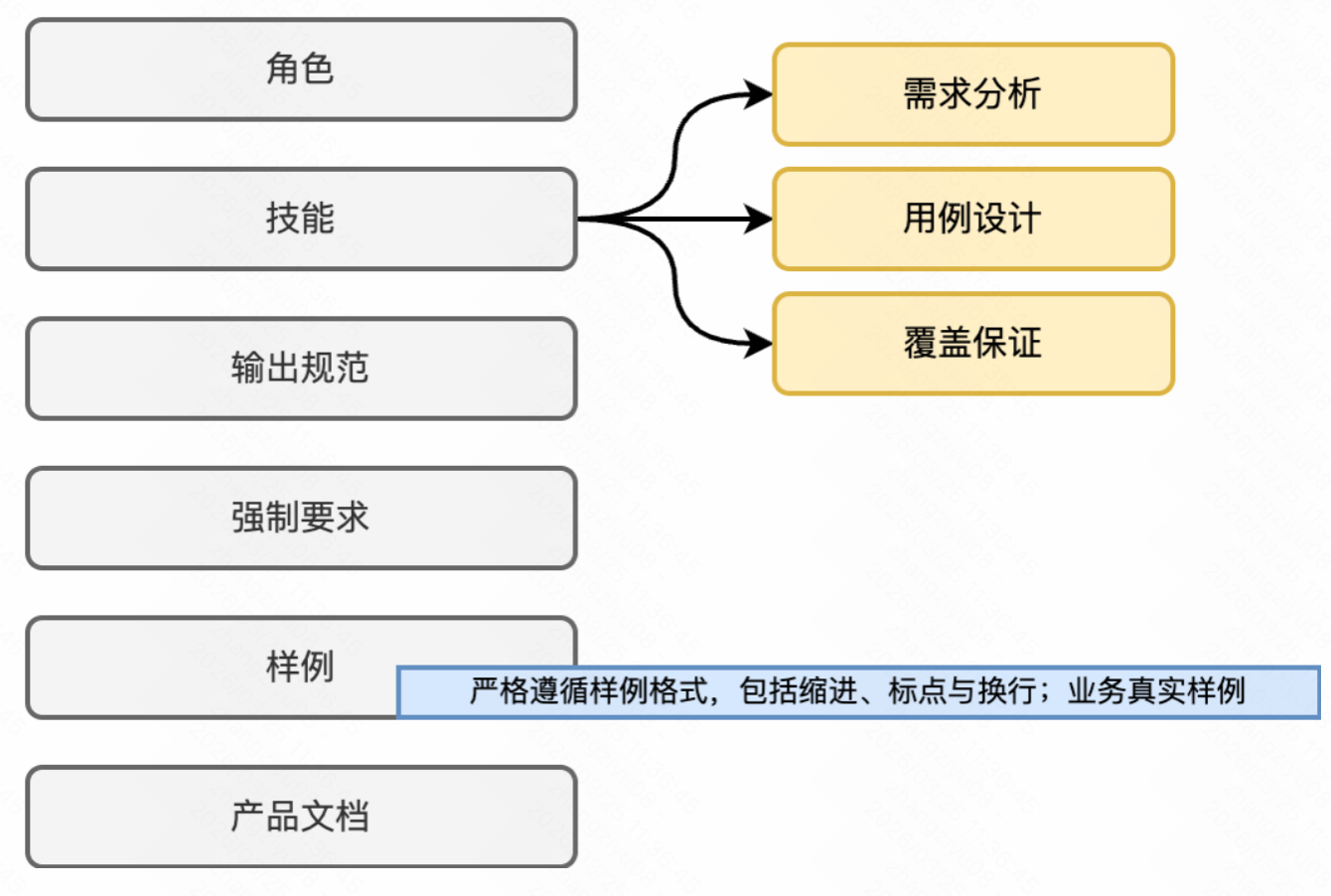

Prompt结构设计

初版Prompt架构

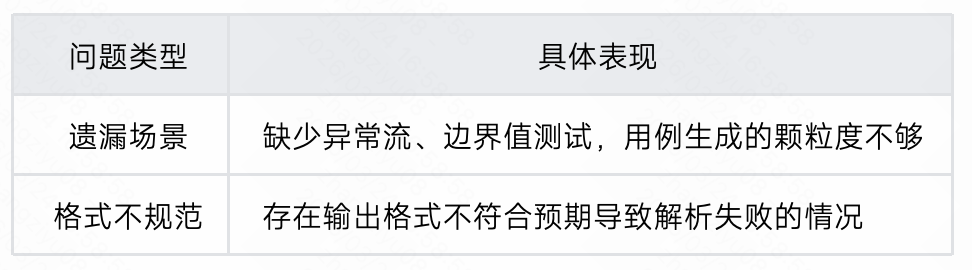

存在的问题

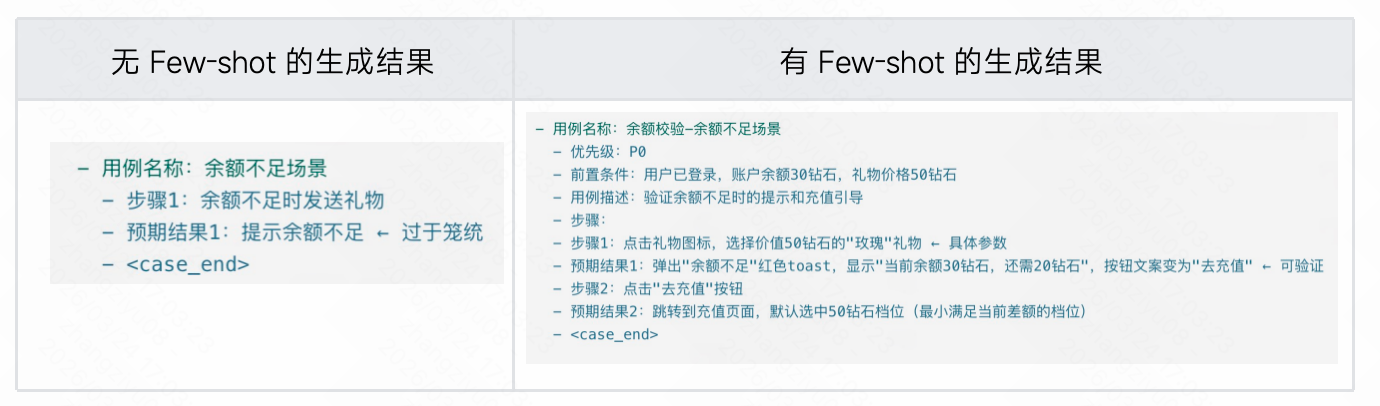

问题分析:生成的用例质量仍参差不齐,主要原因是模型对“高质量用例”的标准理解不足。

解决方案:引入来自业务真实场景的高质量测试用例作为样本,提升模型输出的一致性和专业性。

Few-shot Prompt架构:

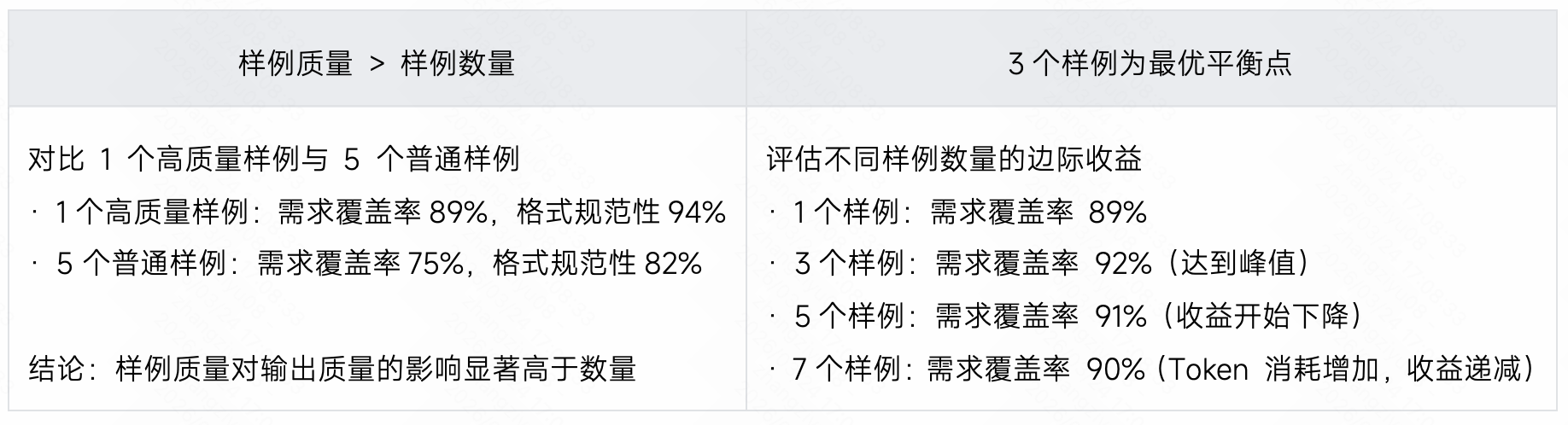

关键发现:

提供3个样例为性价比最优选择(边际收益趋于平缓)

样例质量远重于数量(1个高质量样例 > 5个低质量样例)

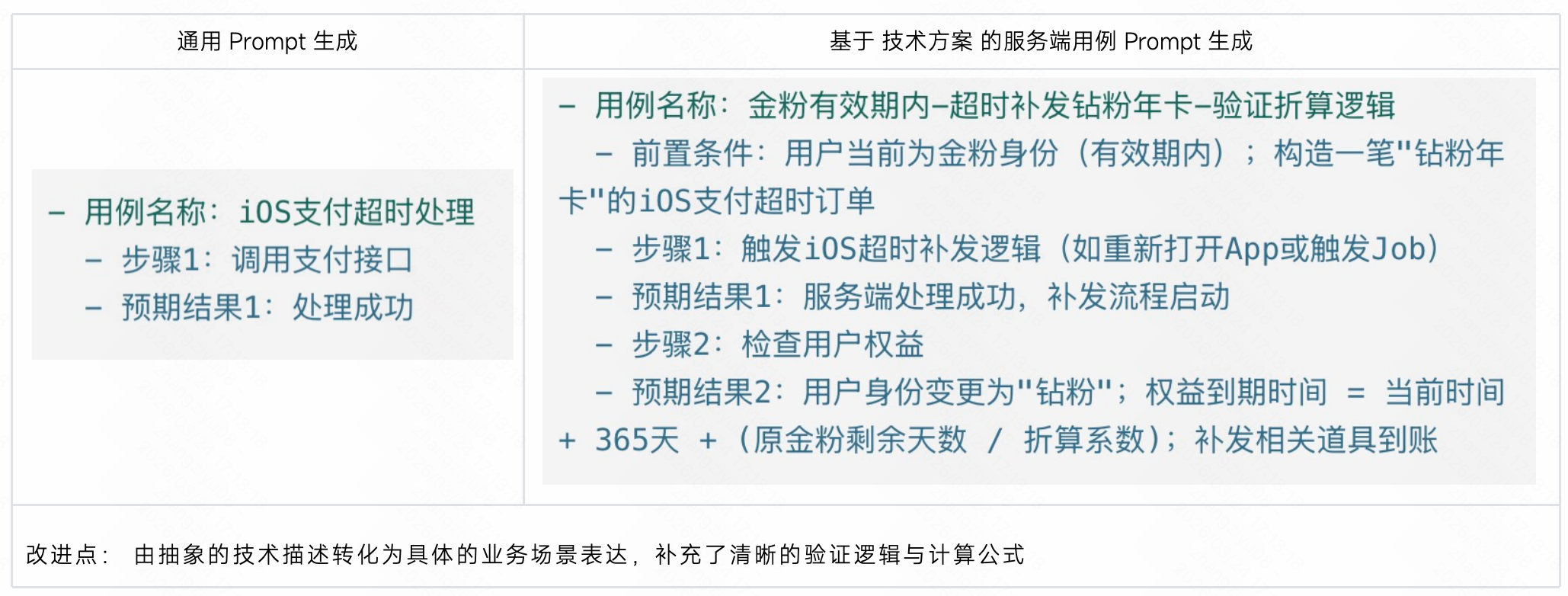

实际生成效果对比:

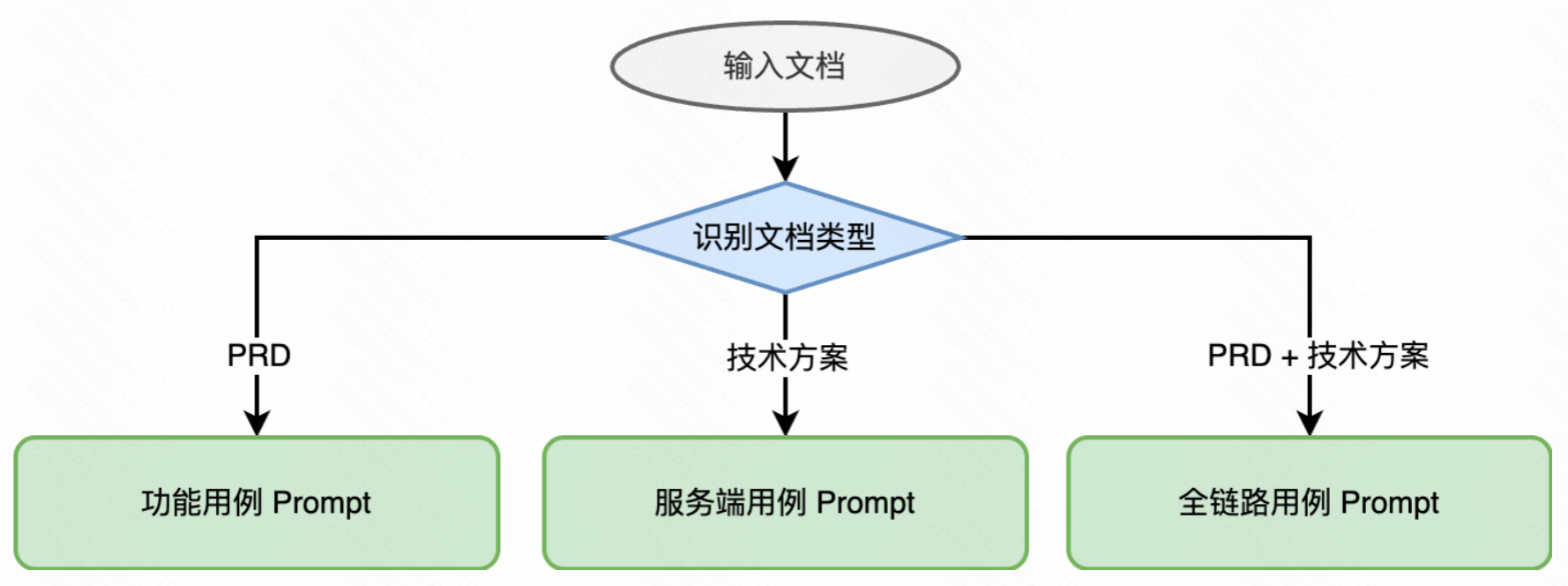

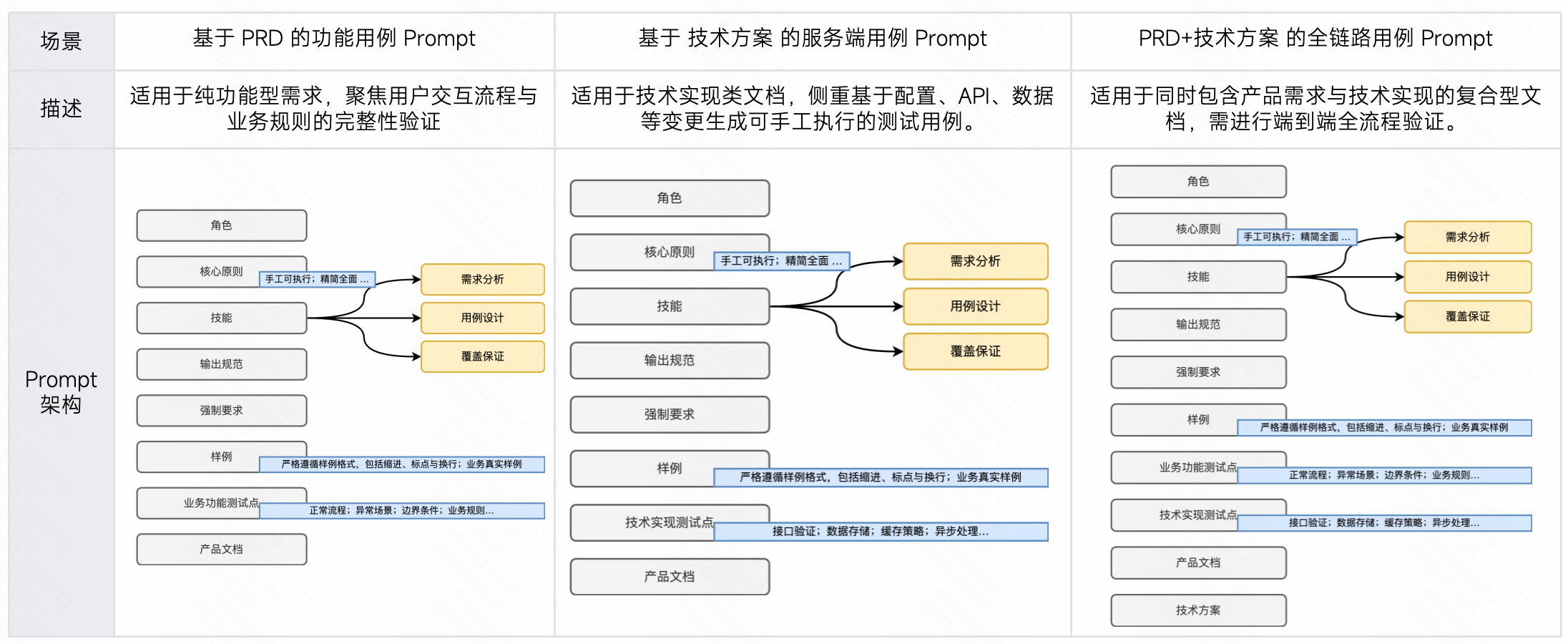

问题分析:不同类型的需求文档(如 PRD、技术方案 等)需要匹配差异化的测试策略,通用 Prompt 难以覆盖多样化测试目标与表达要求。

解决方案:构建多场景路由机制,依据输入文档的类型自动匹配最优的 Prompt 模板,实现精准化、专业化测试用例生成。

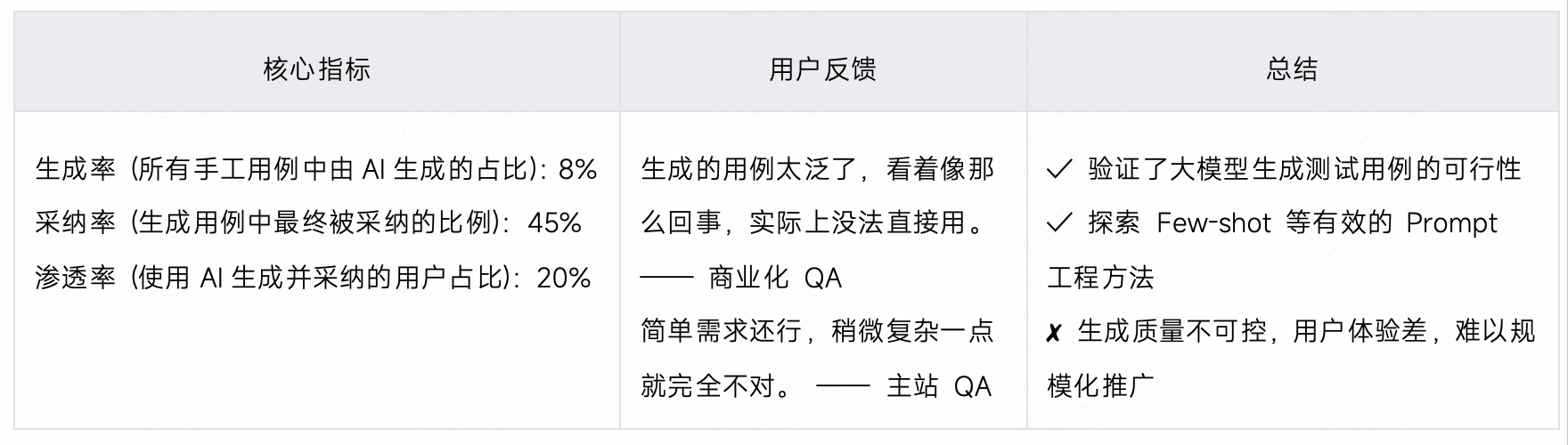

3.1.3效果测评

为了验证 Prompt 优化策略的有效性,我们针对多个关键动作开展了系统性测评。测评基于真实业务场景中的 PRD 和技术方案文档,采用统一测试集进行对比评估。

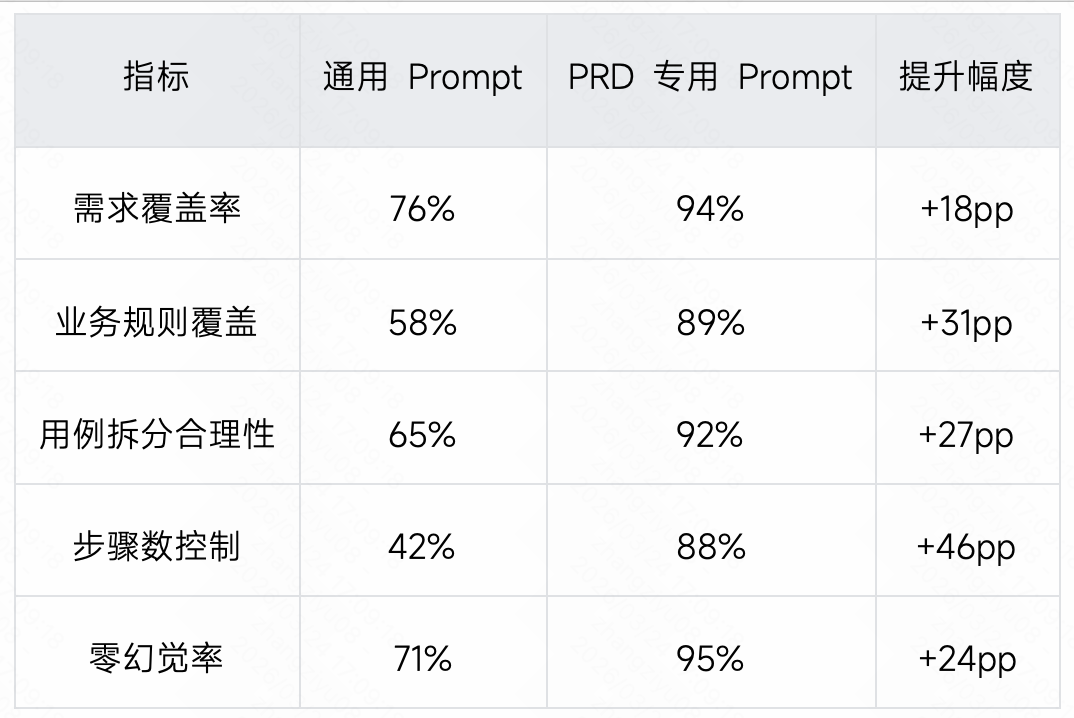

测试场景: 基于 PRD 生成功能测试用例(礼物贴纸玩法模块)

对比组:

对照组: 无 Few-shot 的初始版本 Prompt

实验组:引入3个高质量样例的 Few-shot Prompt

测评结果:

关键发现:

测试场景: 基于不同类型文档生成测试用例

对比组:

对照组:通用 Prompt(不区分文档类型)

实验组: 场景化 Prompt(根据文档类型自动匹配专用模板)

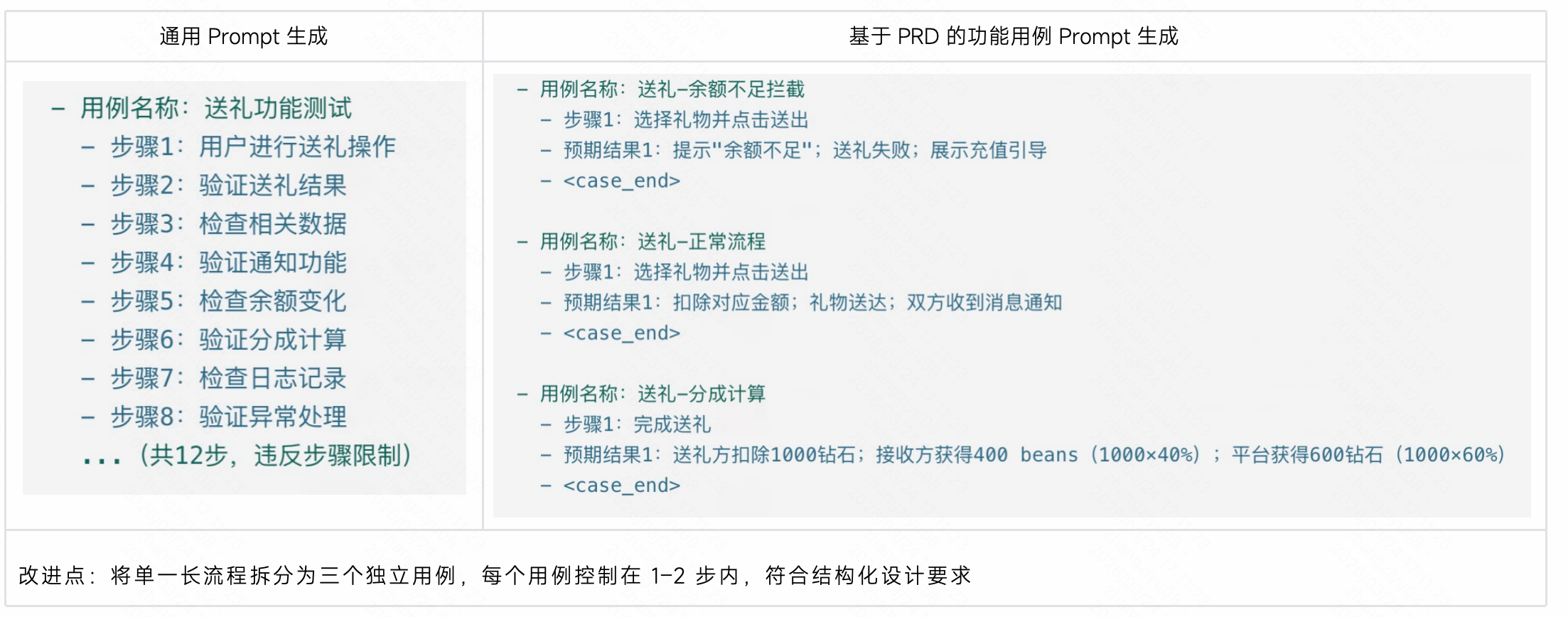

场景1:PRD 功能用例生成

典型改进案例:

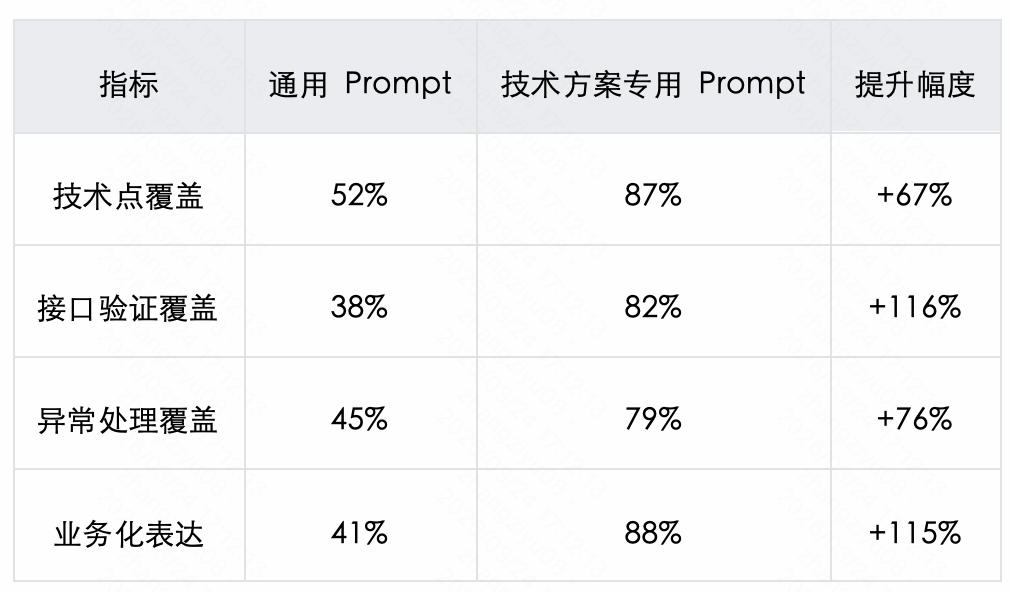

场景2:技术方案用例生成

典型改进案例:

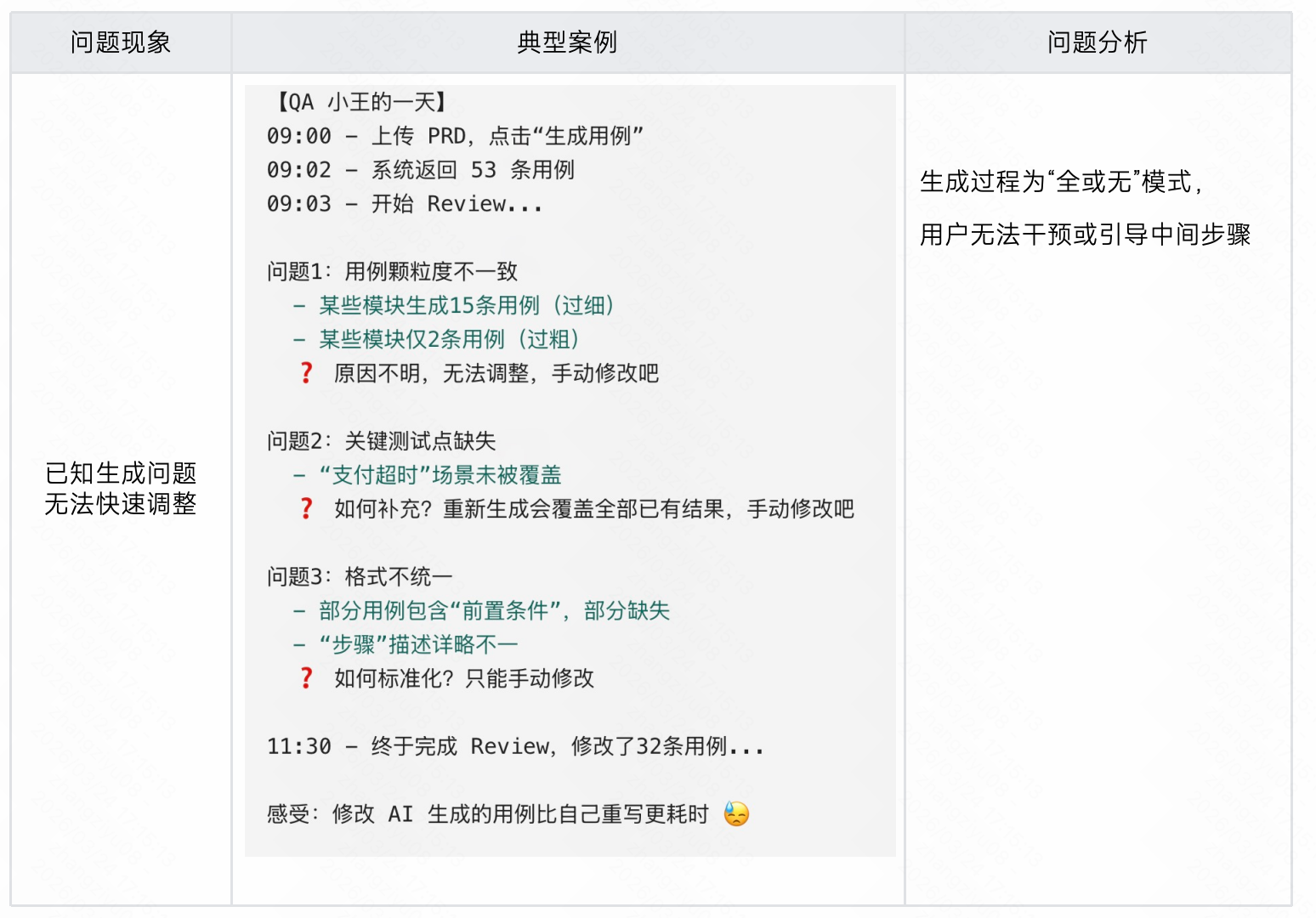

尽管经过多轮优化,V1.0 仍面临三大难以突破的瓶颈:

问题2:缺乏业务背景知识

问题3:生成过程“黑盒”

3.1.5 阶段总结

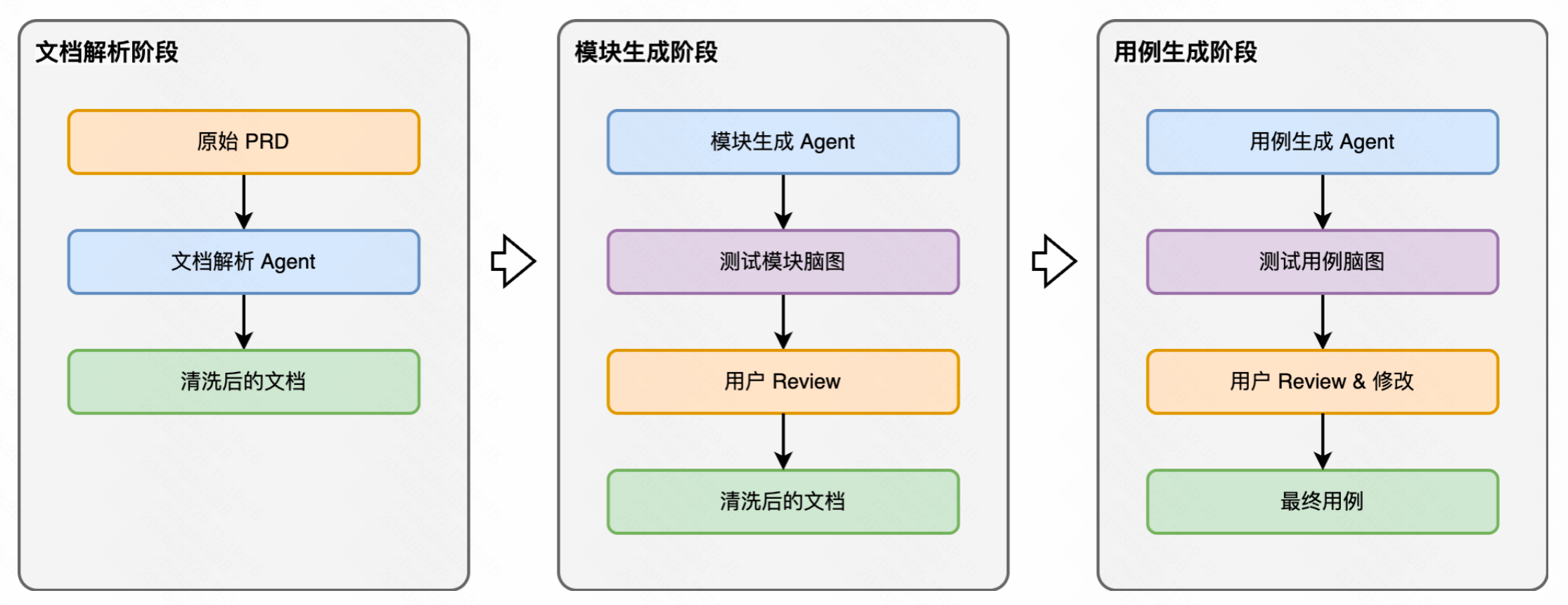

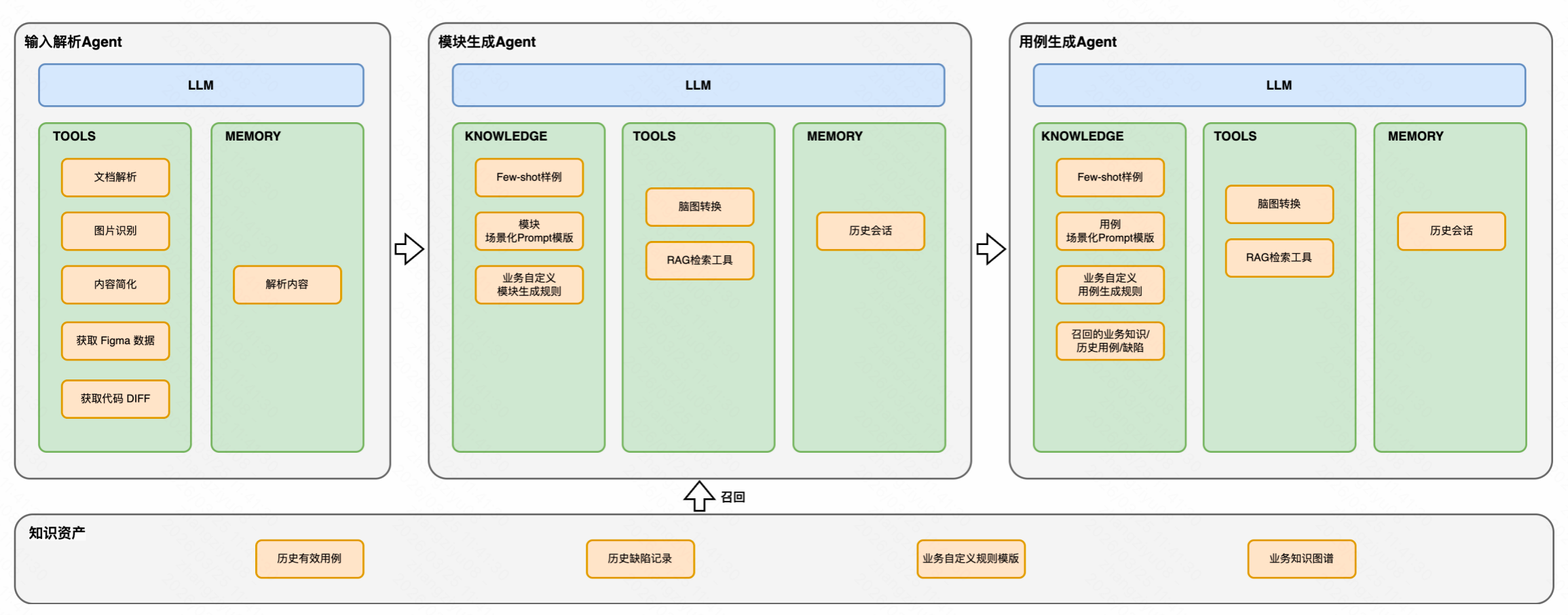

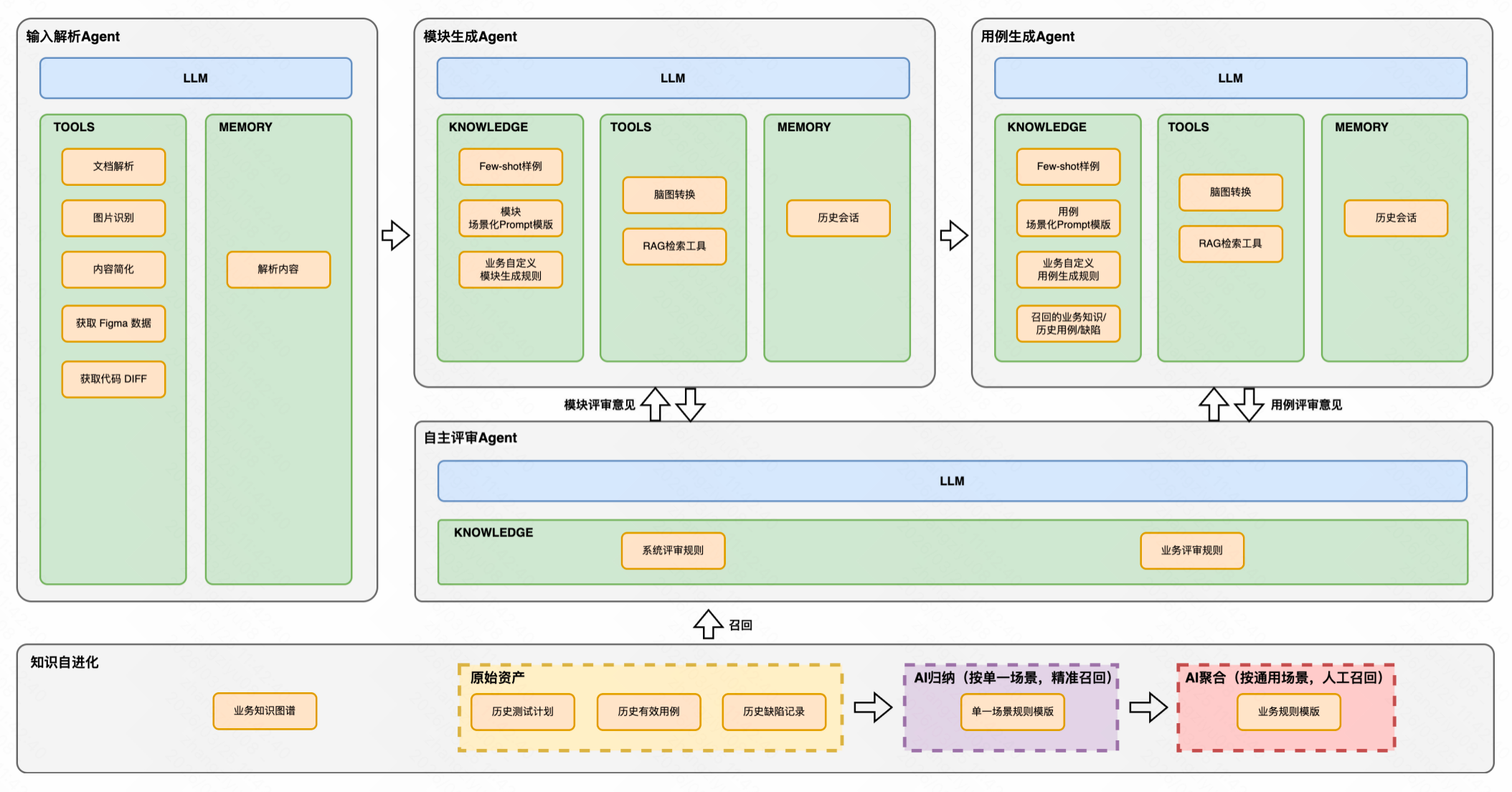

3.2 V2.0版本:Multi-Agent 协作与人机交互阶段

3.2.1 设计理念转变

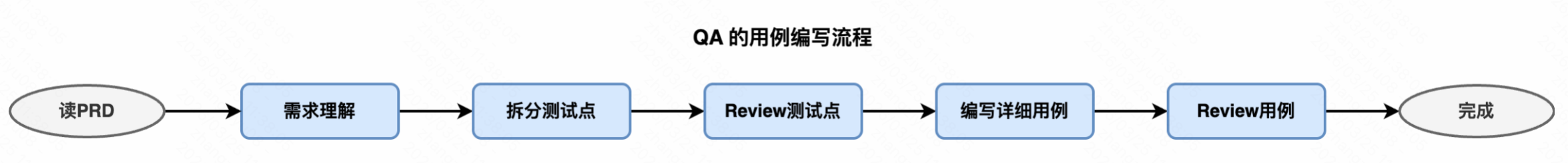

1. QA 会先“拆解测试点(模块)”再“细化为具体用例”

2. 每个阶段都存在 Review 环节,便于及时纠偏

3. 若前期阶段出现偏差,后续将越走越偏

基于此,我们对于V2.0采用了新的设计思路,即模拟人类思维方式,引入Multi-Agent协作机制,并在关键节点支持人工介入。

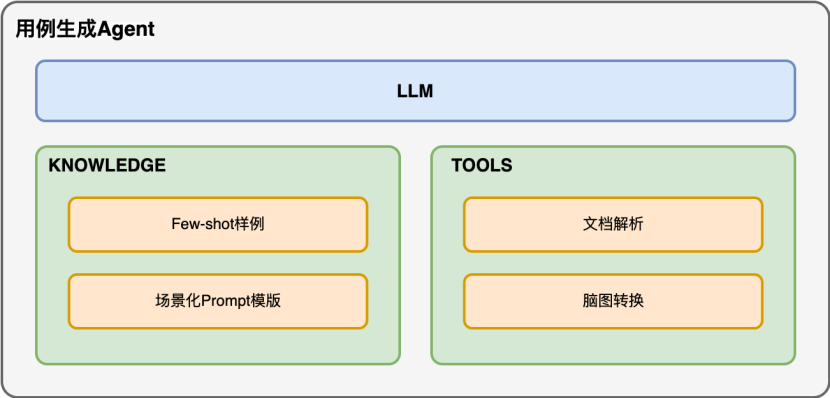

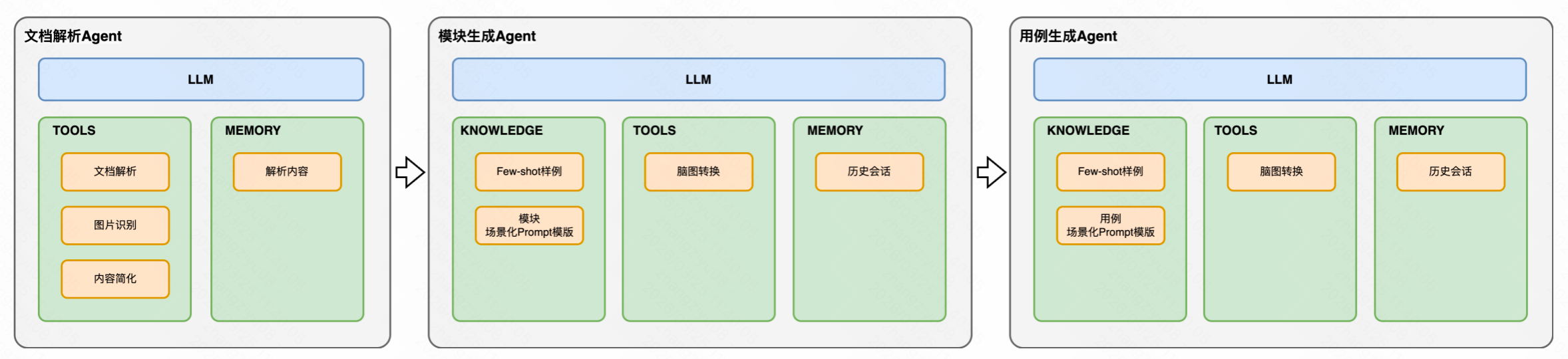

技术架构

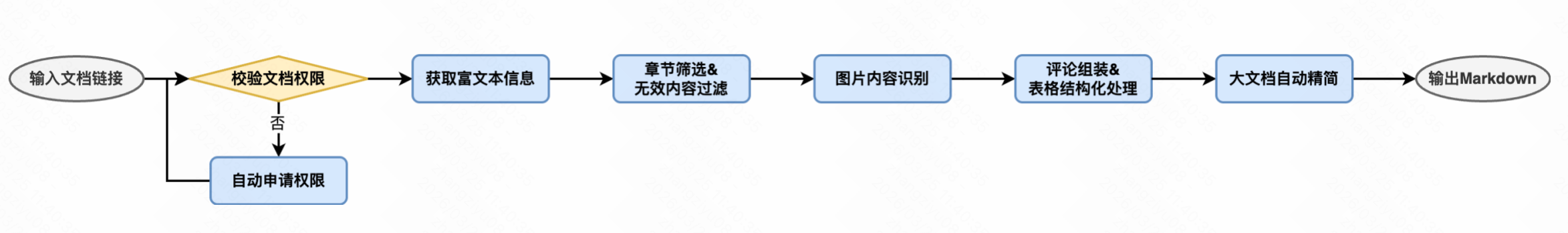

这一Agent的职责是,对多种格式的输入文档进行标准化处理,提取其中的有效信息。

文档解析流程:

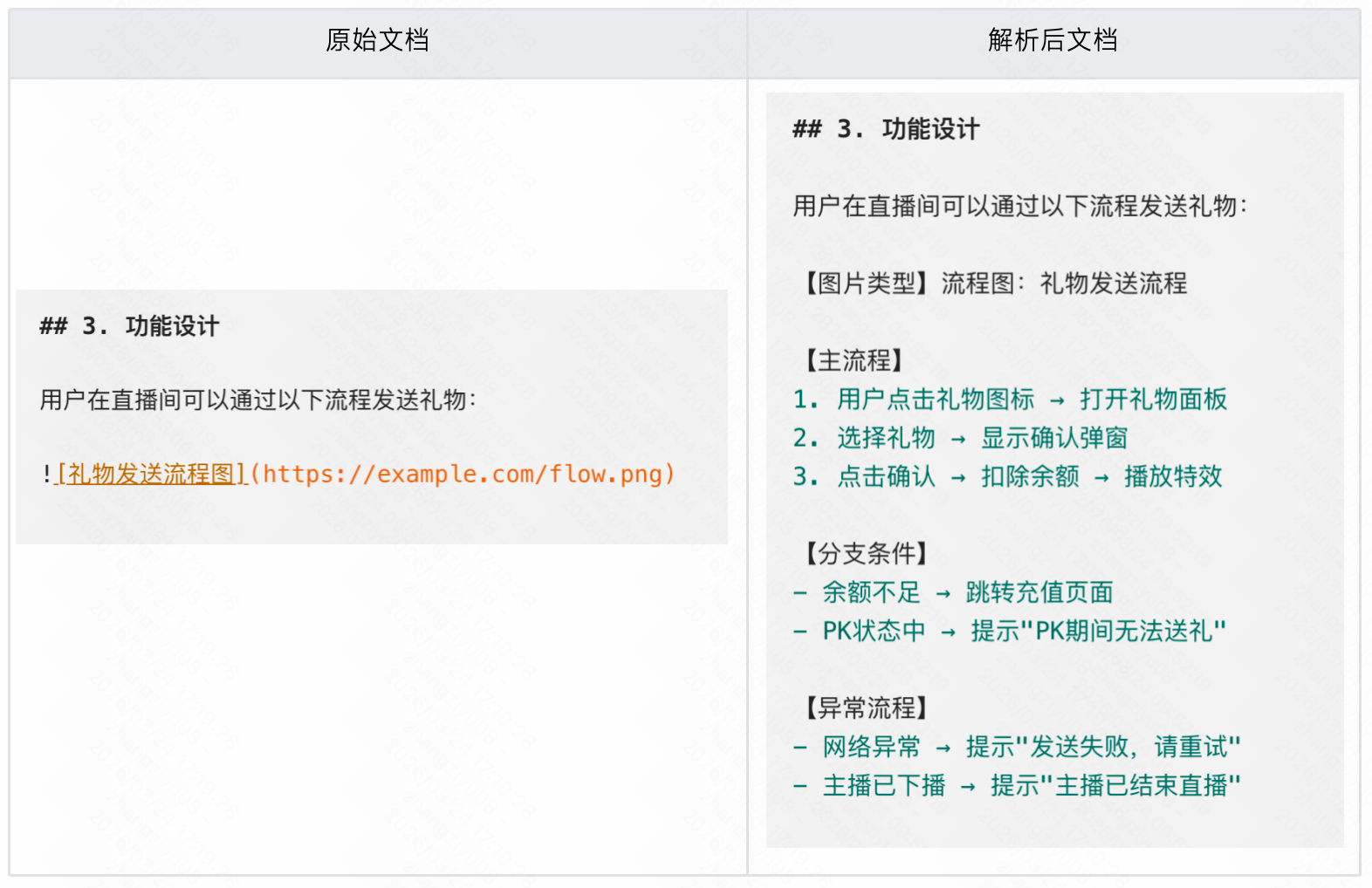

实际案例

效果示例:

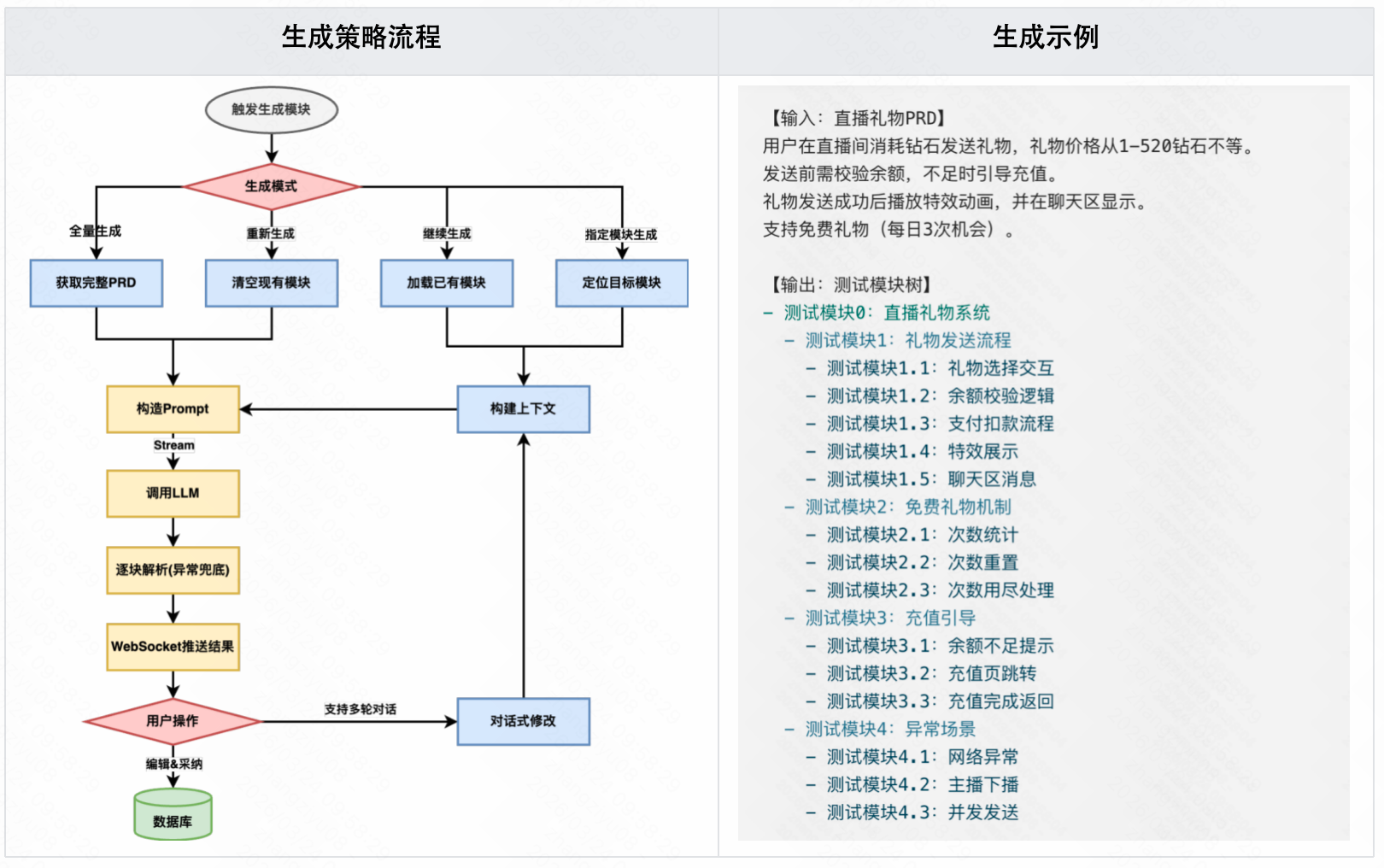

这一Agent的职责是从清洗后的文档中提取测试点,生成结构化的测试模块树。

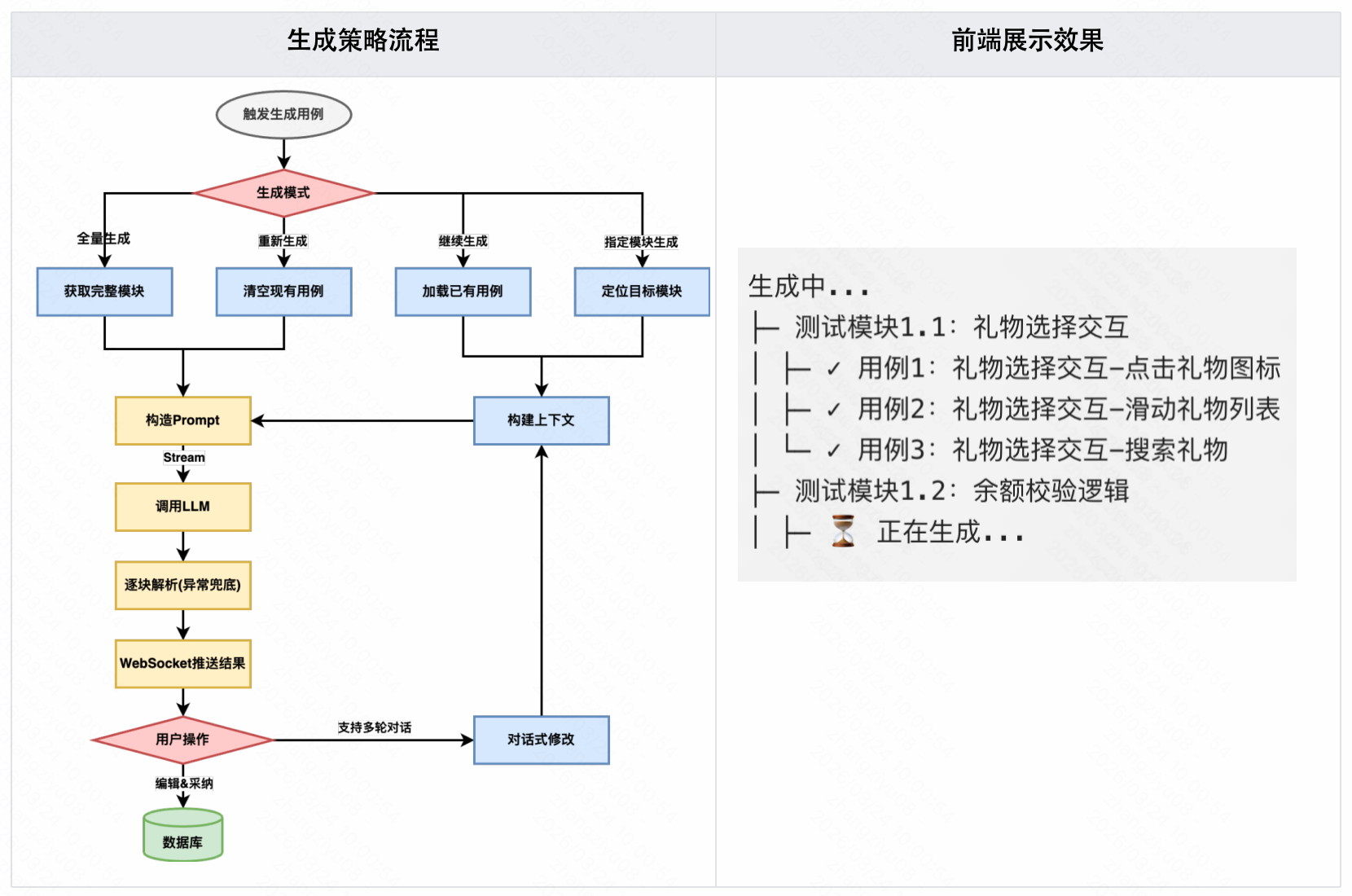

这一Agent的职责是,基于用户确认的测试模块,生成详细的测试用例。

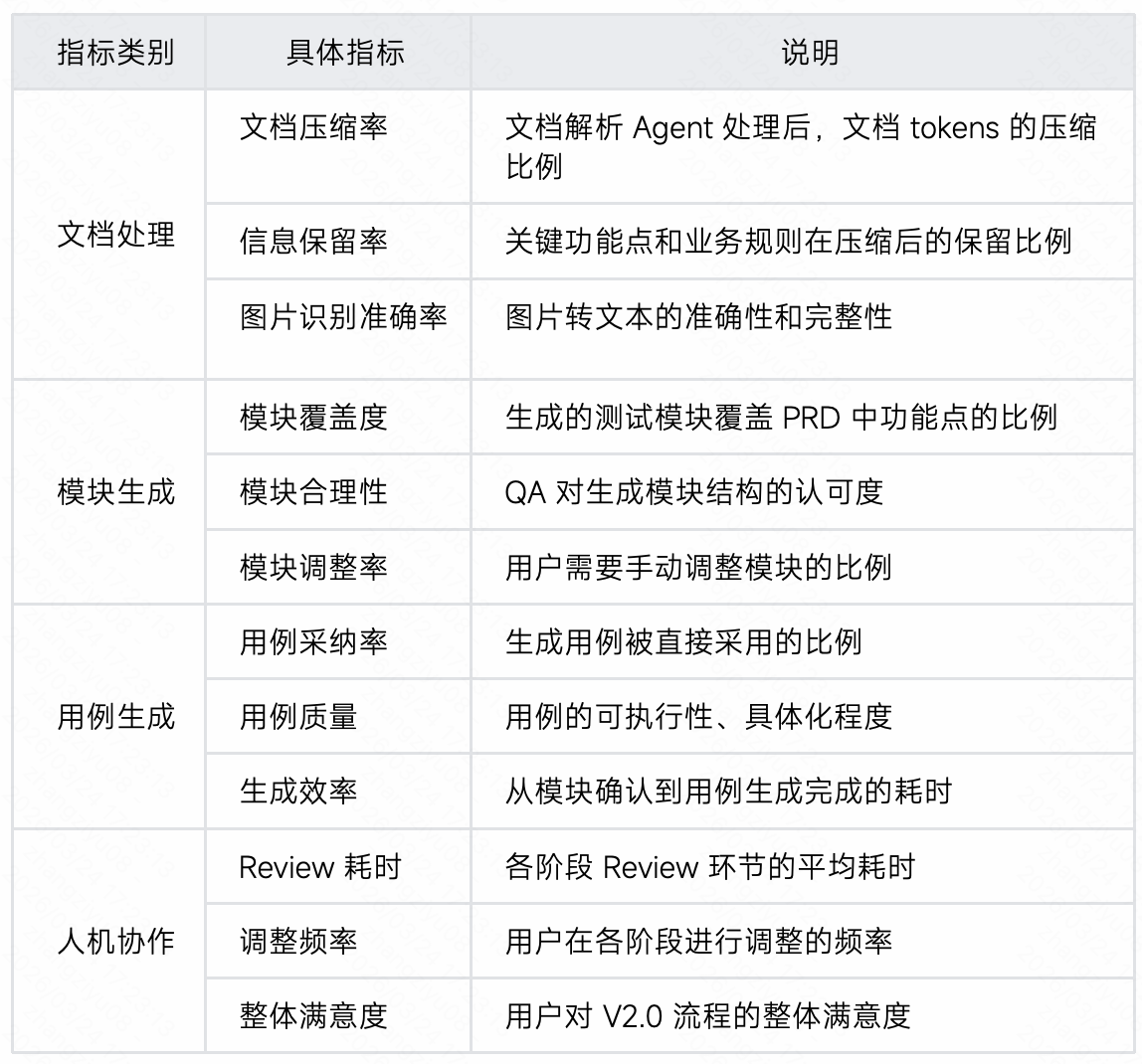

为验证 Multi-Agent 架构与人机协作机制的有效性,我们针对 V2.0 版本的关键动作开展了基于真实业务场景的系统性测评,从多个维度对比 V1.0 与 V2.0 的表现差异。

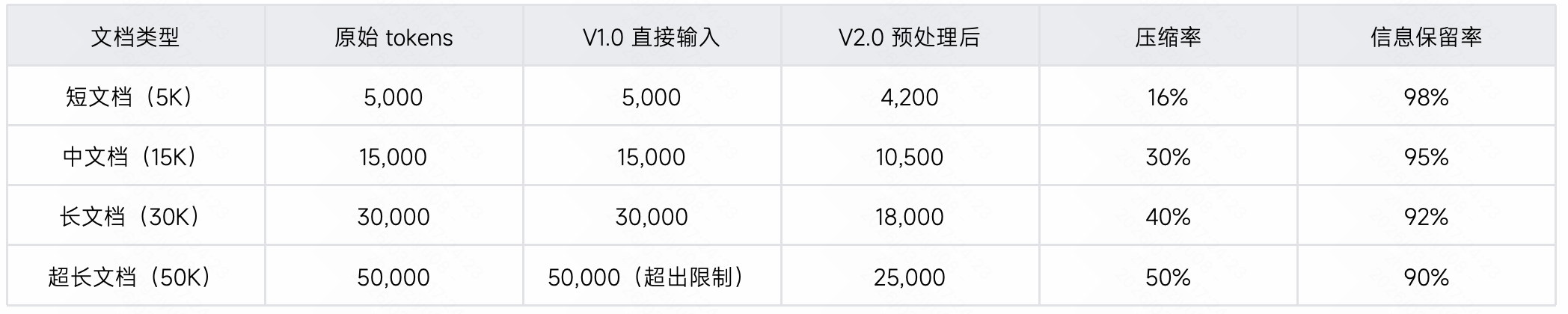

测试场景: 处理不同长度和复杂度的 PRD 文档

对比组:

对照组:V1.0 直接输入完整文档

实验组:V2.0 经文档解析 Agent 预处理后输入

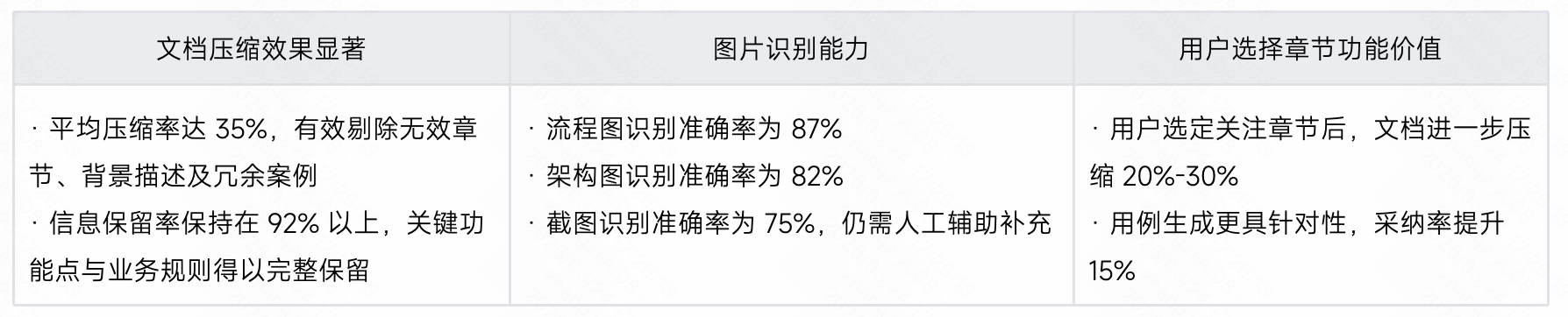

测评结果:

关键发现:

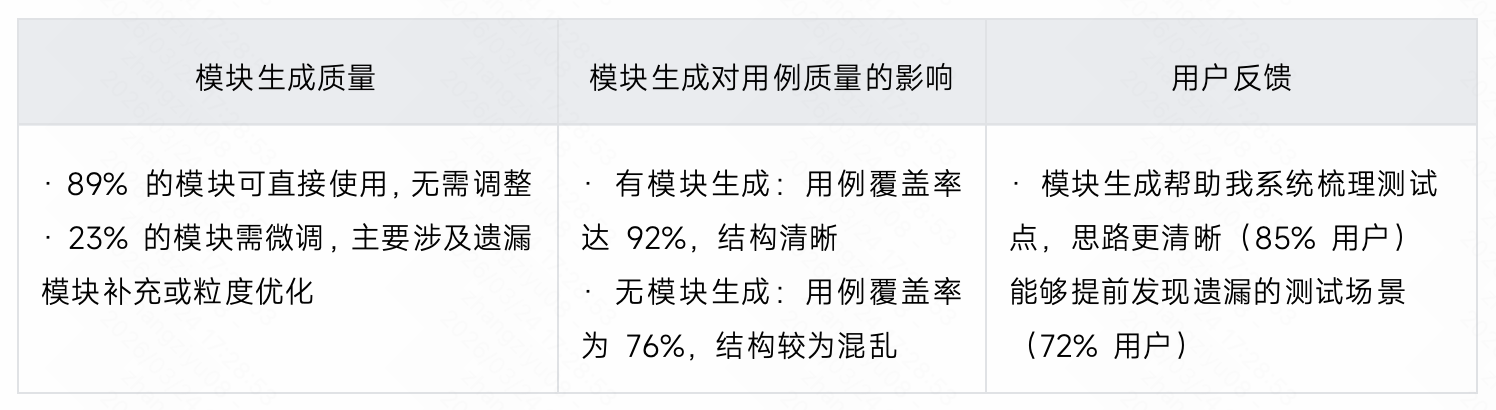

测试场景: 基于预处理后的文档生成测试模块树

测评结果

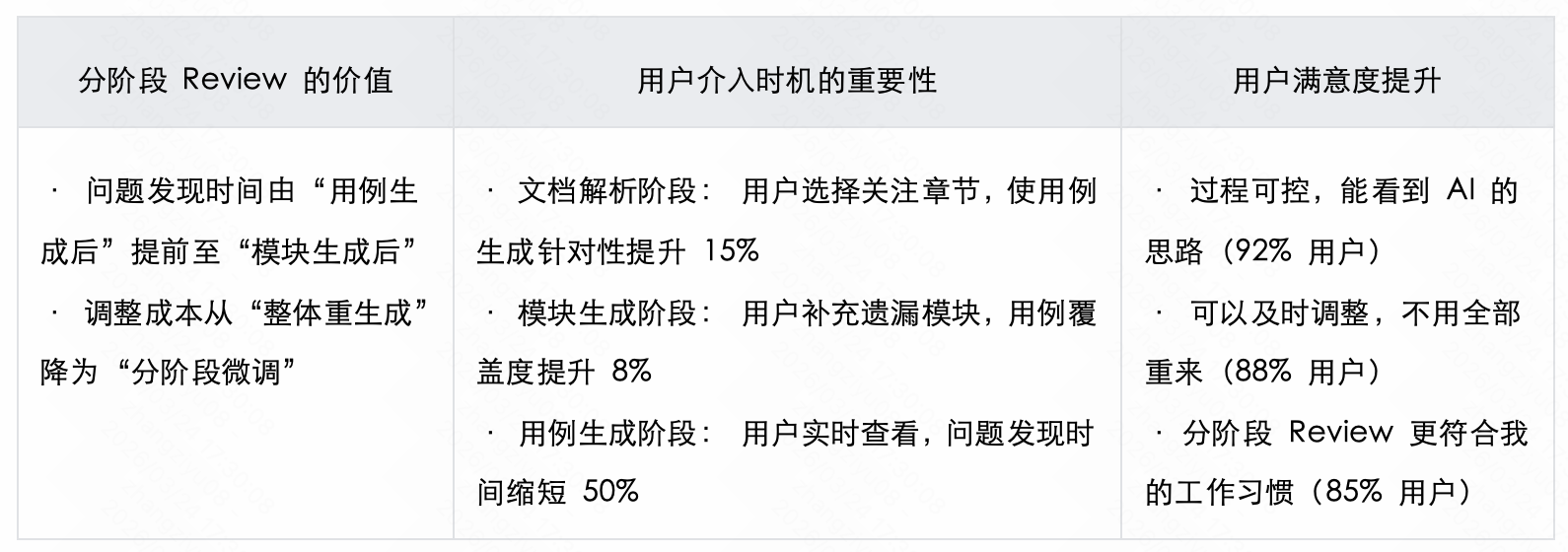

测试场景: 对比 V1.0(黑盒模式)与 V2.0(分阶段 Review)的用户体验与效率

测评结果

关键发现:

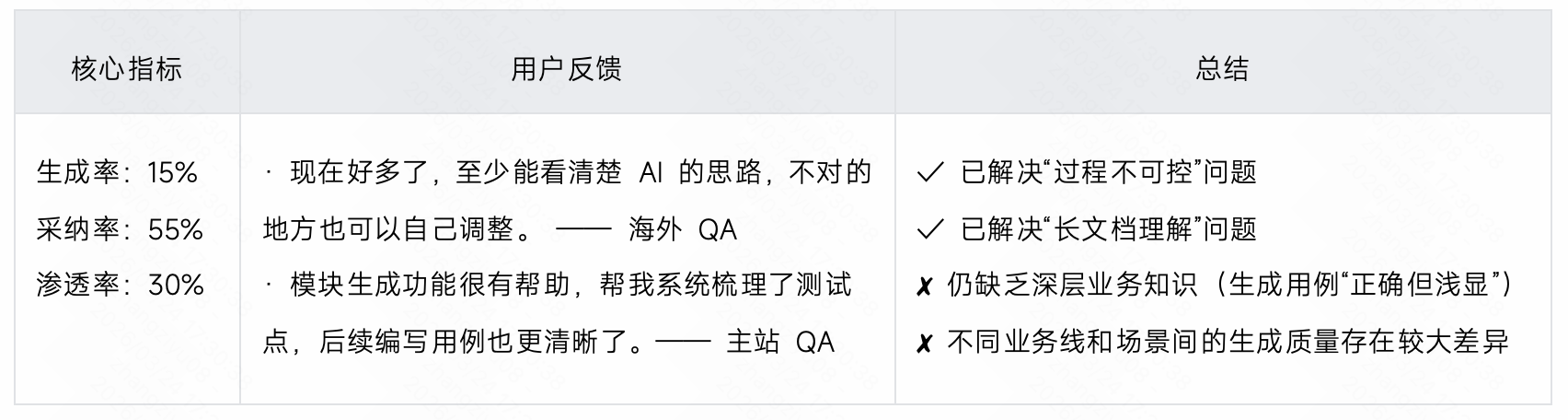

3.2.5 阶段总结

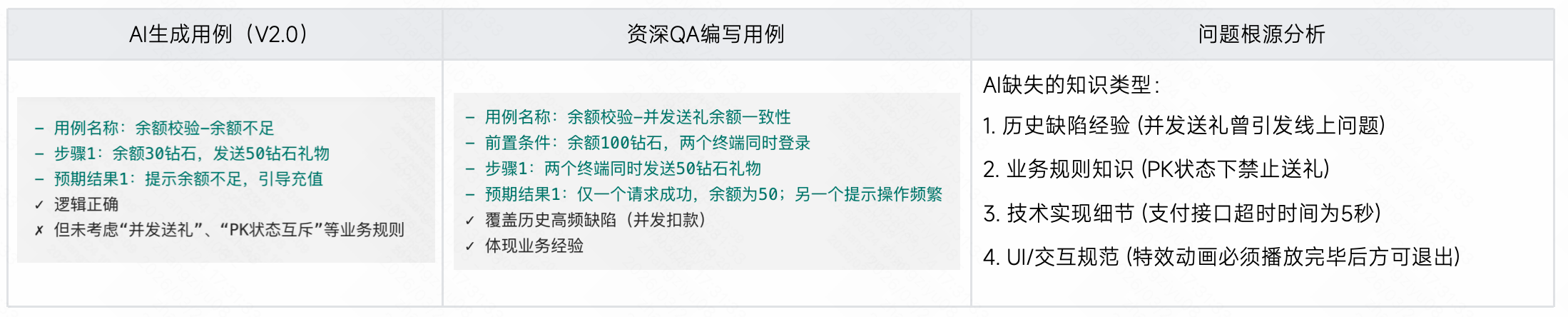

我们发现,V2.0遗留着一个核心问题,即生成的用例缺乏“业务深度”。

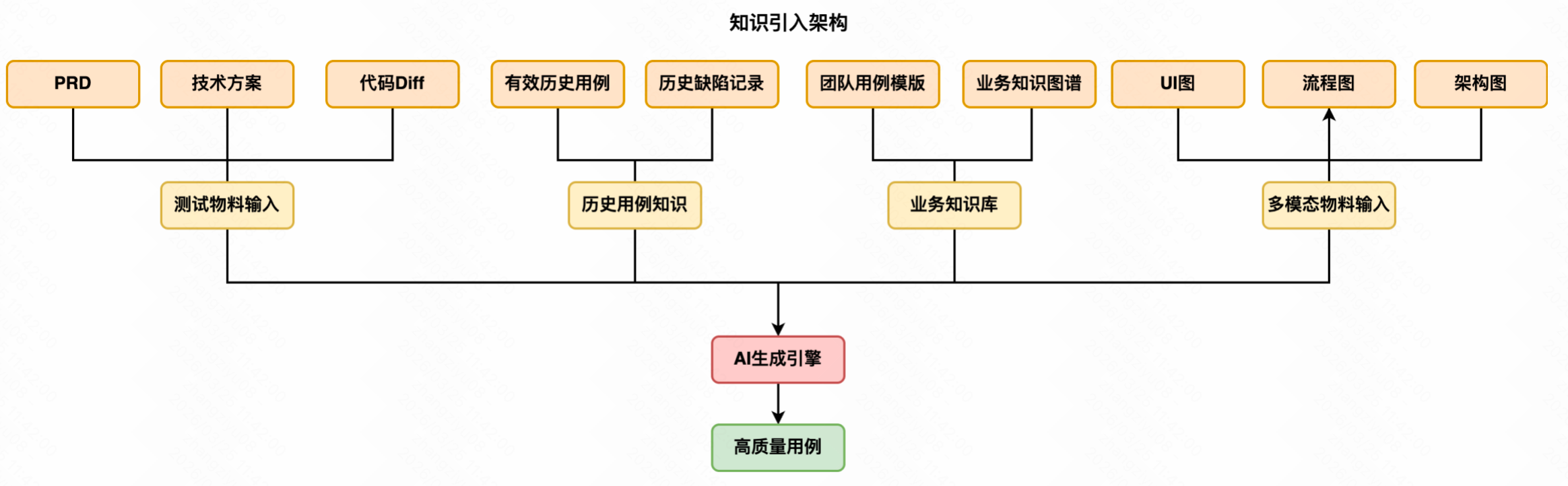

基于此,我们调整了V3.0的设计目标,即构建体系化的知识引入机制,使 AI 具备“懂业务”的能力。

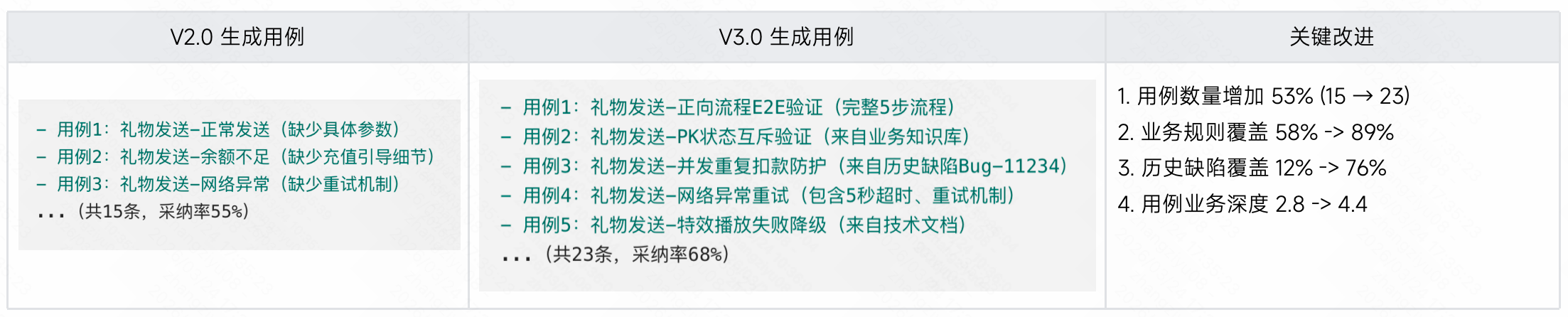

召回结果的价值:

1. 提供了详细的步骤参考(如“URL参数携带need_amount”)

2. 补充了业务规则(如“充值后自动返回”)

3. 最重要:带入了历史缺陷经验(并发重复扣款、支付超时重复订单)

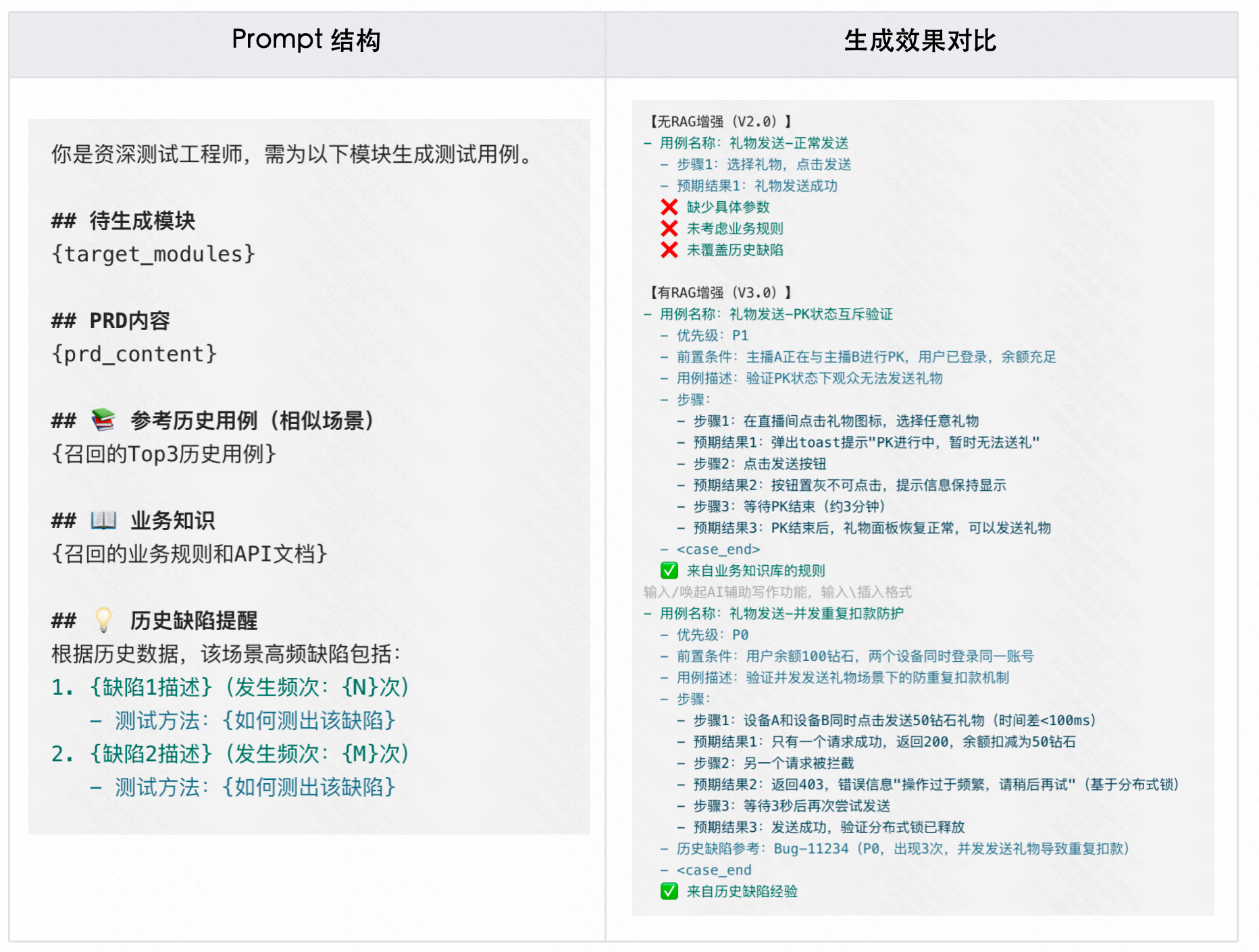

基于 RAG 增强的用例生成

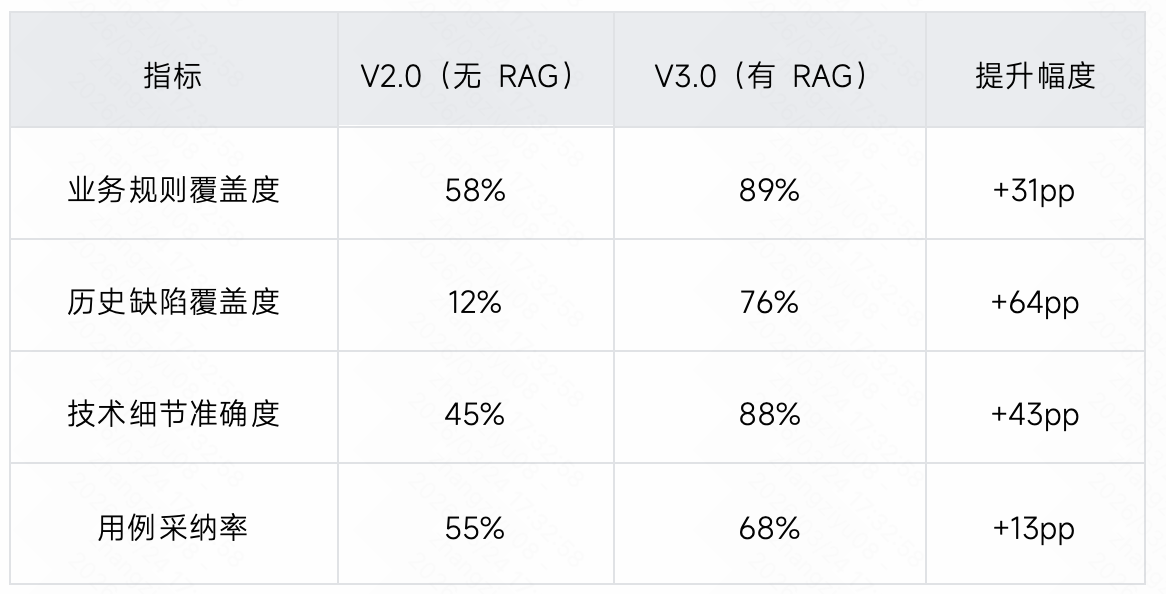

为验证体系化知识引入机制的有效性,我们针对 V3.0 的关键功能进行了基于真实业务场景的系统性测评,从多个维度对比 V2.0 与 V3.0 的表现差异。

测试场景: 基于 PRD 生成测试用例,对比有无 RAG 增强的效果

对比组:

对照组:V2.0 仅基于 PRD + Few-shot 样例生成用例

实验组:V3.0 基于 PRD + RAG 检索的历史用例和业务知识生成用例

测评结果:

关键发现:

关键发现:

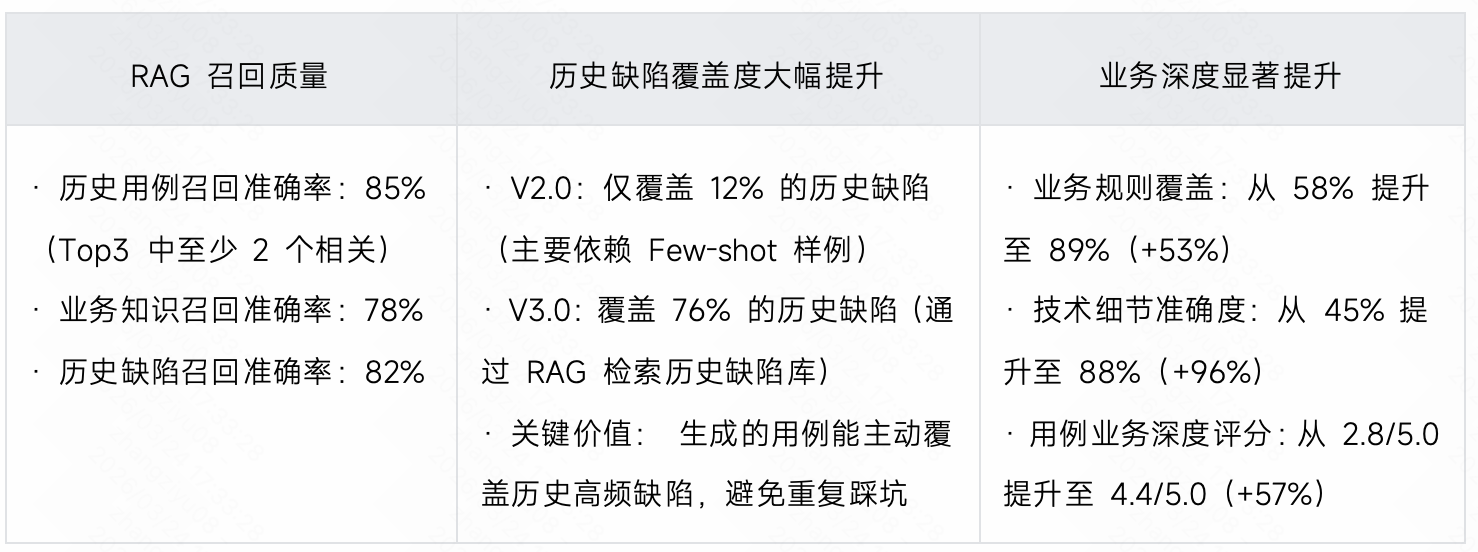

测试场景: 对比 V2.0 和 V3.0 在整体用例生成质量上的差异

测评结果

典型改进案例:【直播礼物需求】

典型改进案例:【直播礼物需求】

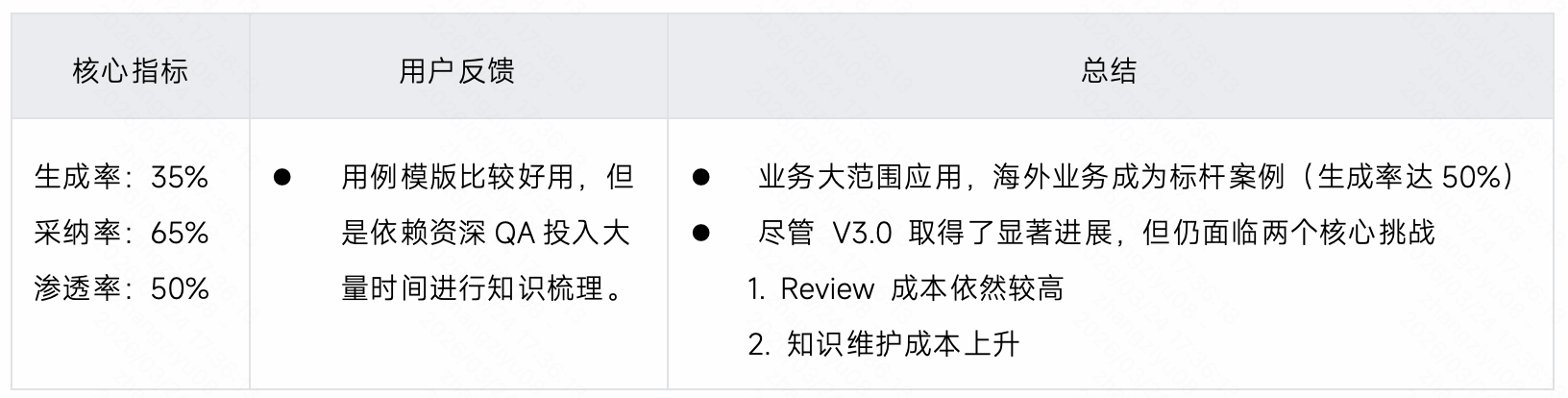

3.3.5 阶段总结

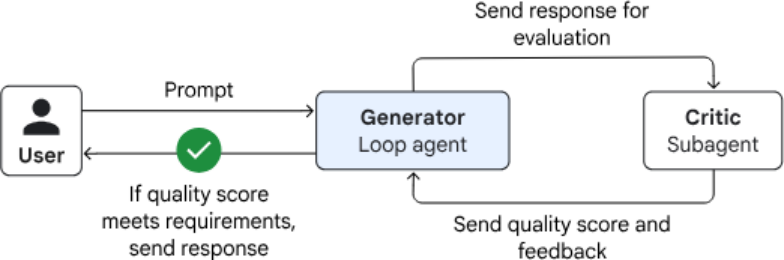

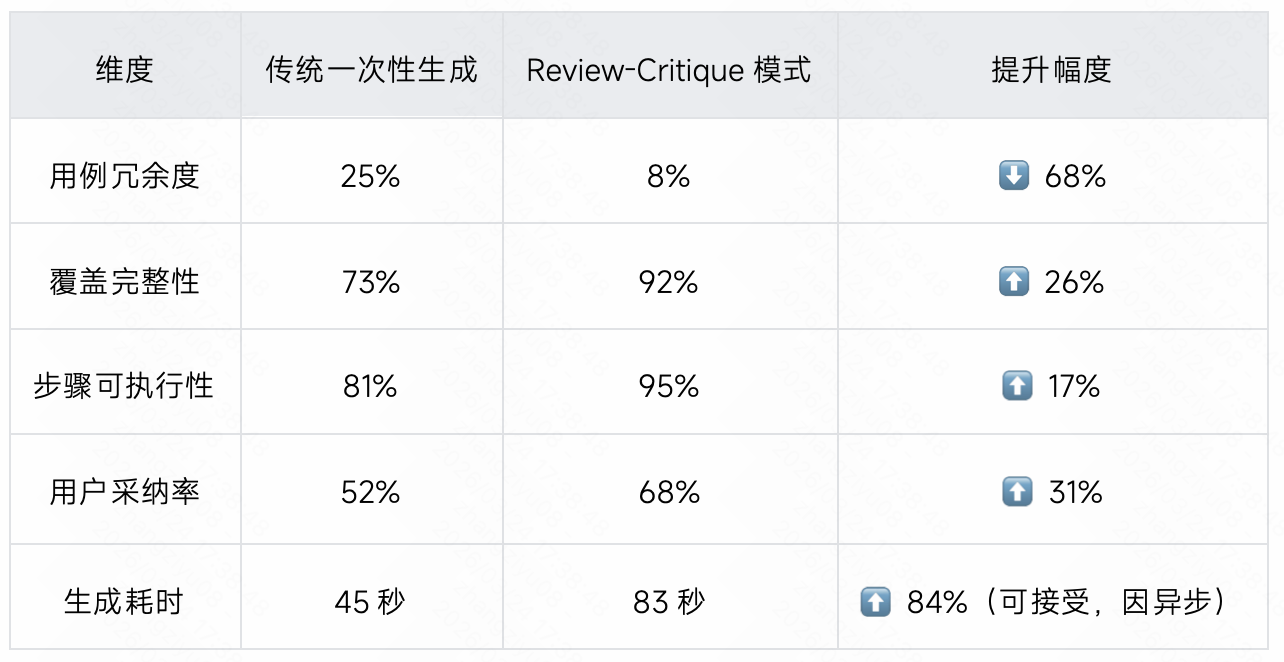

传统的 AI 生成采用“单次直出”模式,类似于只会答题而不会检查的学生。为提升生成质量,需赋予 AI “自我反思”能力,构建“生成-评审-优化”的自主评审闭环机制。

关键设计理念:

Critic(判别):AI 扮演“评审员”角色,对生成结果进行系统性审查并给出专业指导建议

Generator(生成):根据评审意见自动调整与优化输出内容

离线异步:因多轮迭代耗时较长,采用后台处理结合通知机制,保障效率与响应性

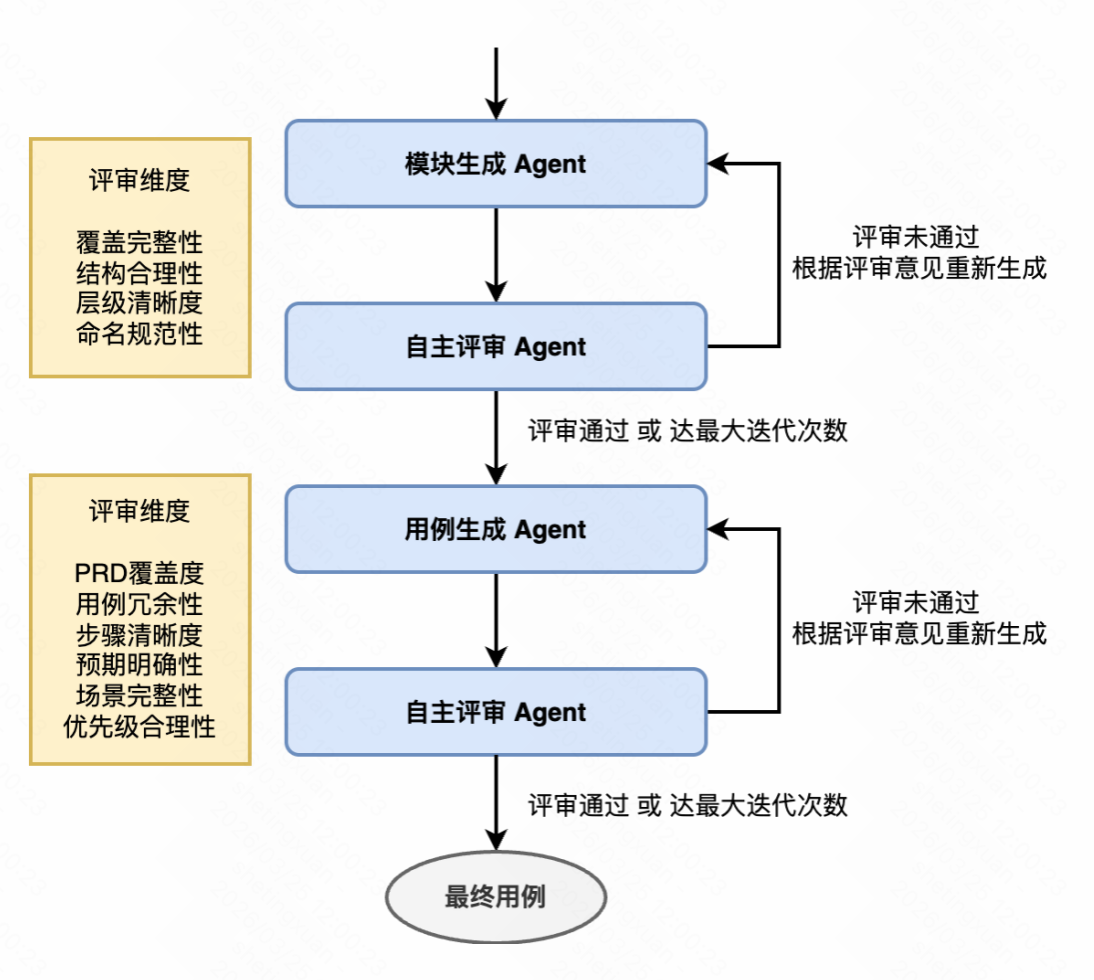

整体架构

阶段一:模块级评审->优化闭环(结构治理)

自主评审Agent —— 模块审查维度详解:

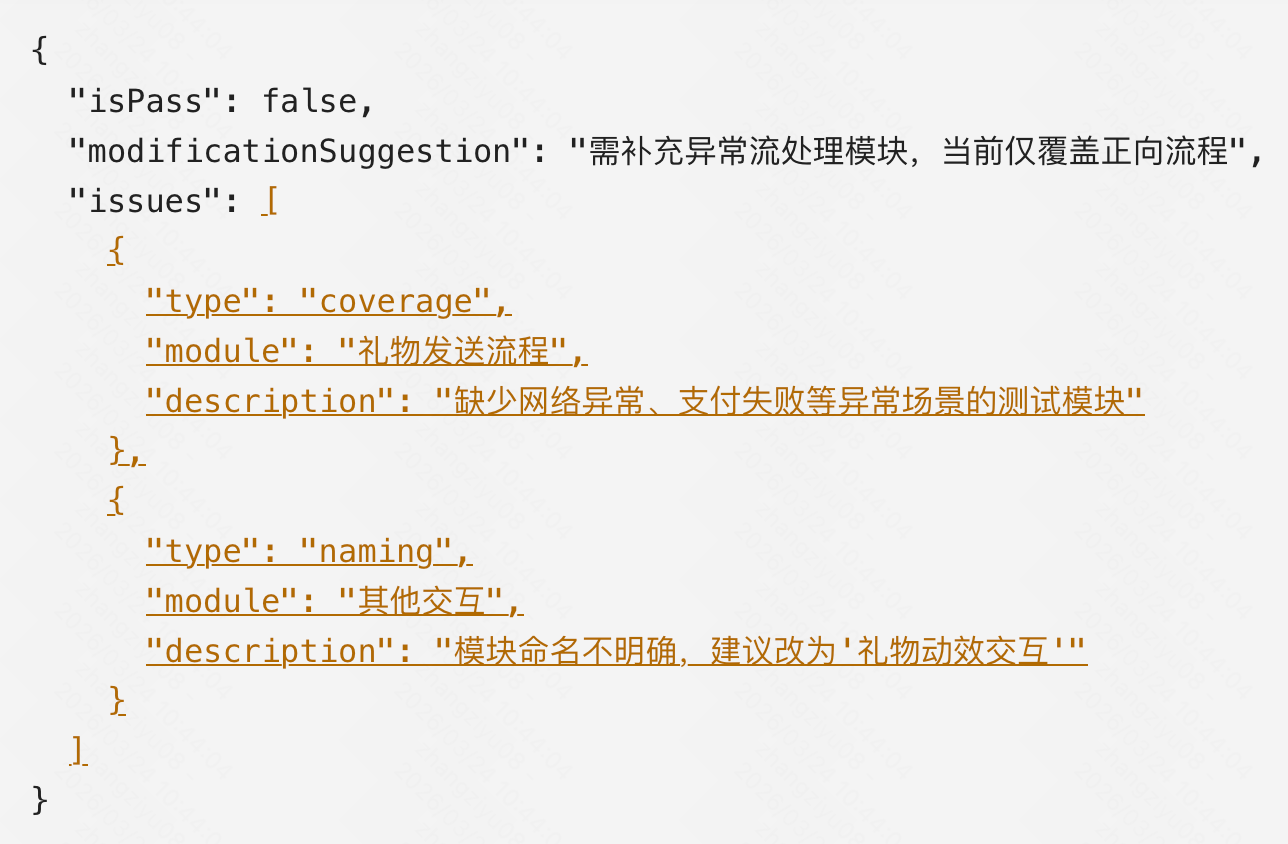

输出示例(未通过):

阶段二:用例级评审->优化闭环(细节打磨)

自主评审Agent

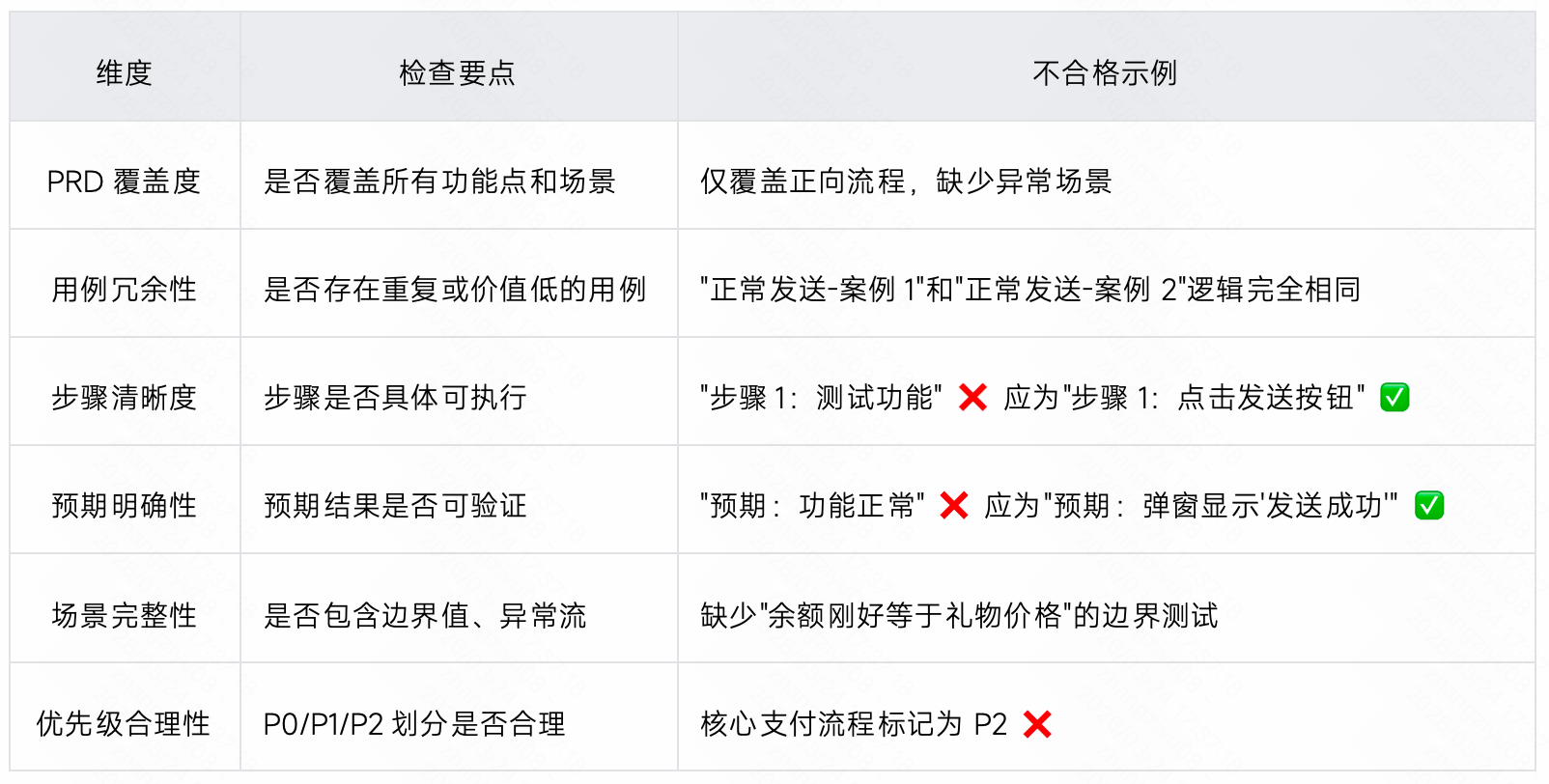

用例审查策略:全局 Review + 逐条细节检查

用例审查维度:

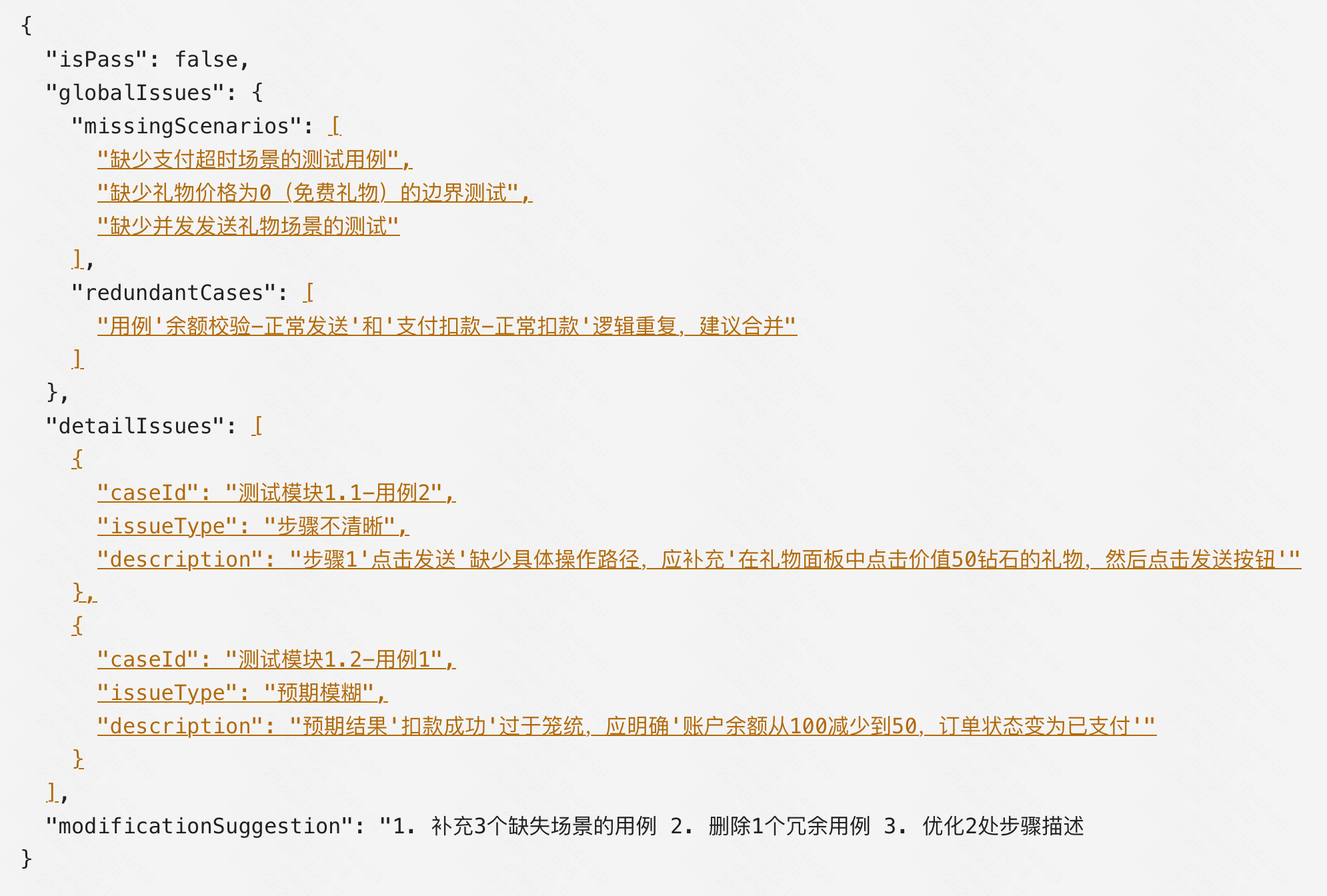

输出示例(未通过):

输出示例(未通过):

对比传统模式的提升:

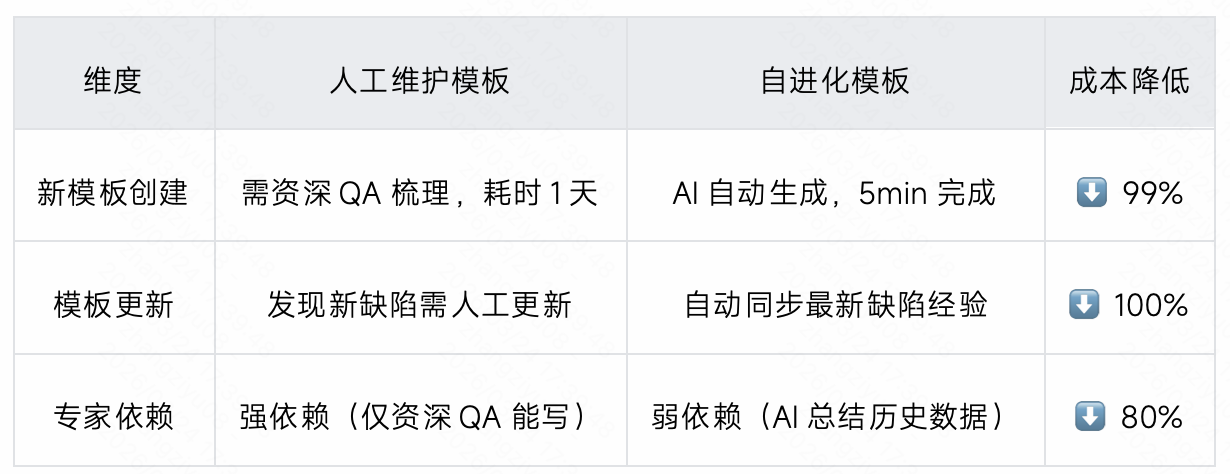

在 V3.0 阶段,为了让 AI 理解业务,需人工编写大量团队业务模板(业务已维护 170+ 套业务定制的团队模板),但该模式存在三大痛点:

1. 维护成本高:每个新业务场景均需人工梳理规则

2. 知识更新慢:历史缺陷经验无法及时同步至模板

3. 专家依赖强:需资深 QA 才能总结高质量模板

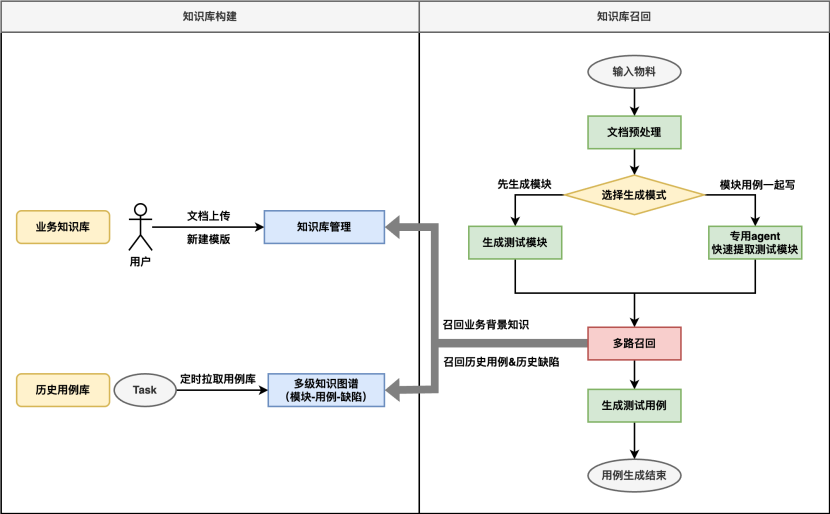

因此,我们的核心设计理念是让系统从历史数据中自动学习,实现隐性知识显性化。

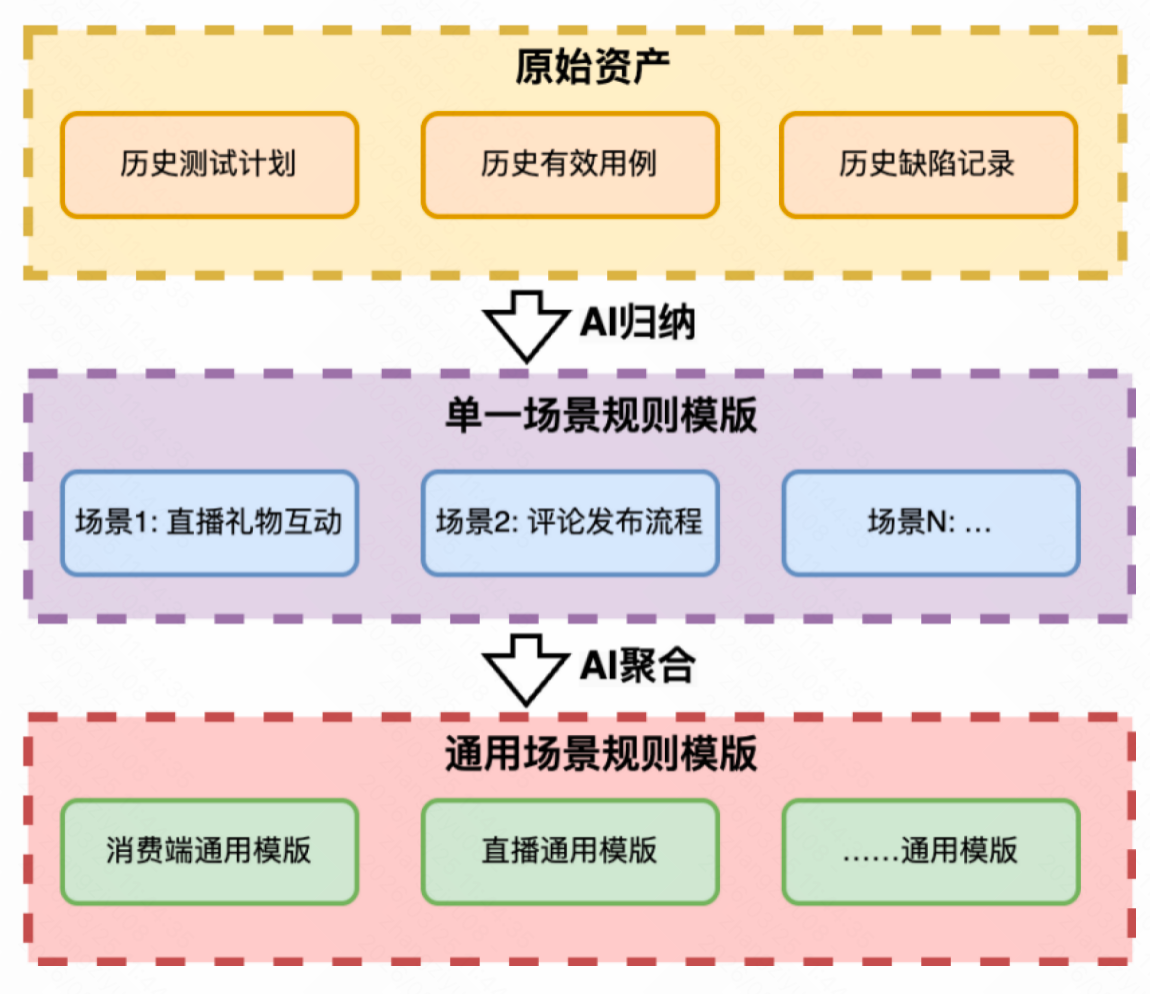

我们构建了两种层级的自进化模板:

定位:针对特定微场景(如“直播间送礼”、“评论输入框”)的精确规则

作用:作为 RAG 链路中的上下文参考;自动补齐测试点,降低遗漏率

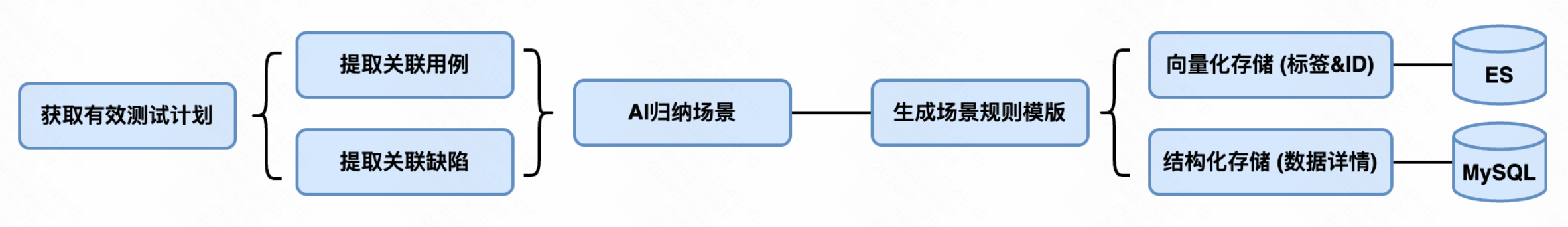

场景模版生成流程

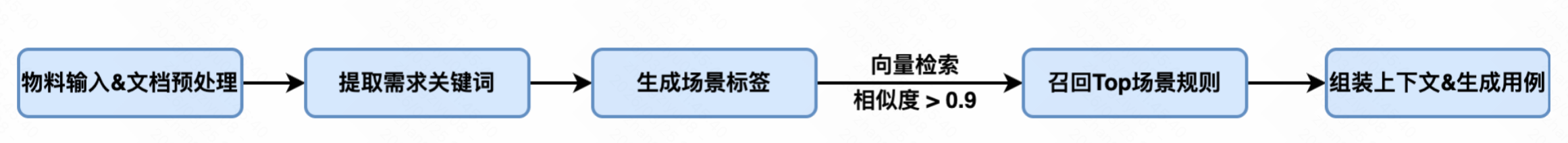

RAG 召回流程

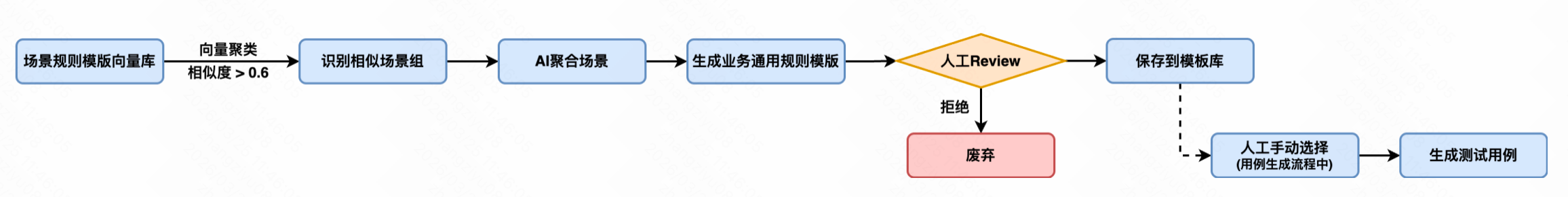

定位:多个相似场景聚合而成的通用规范(如“消费端评论发布通用模板”)

作用:支持手动召回的 RAG 链路;作为明确的生成规则,提升精度

生成策略:

AI聚合核心逻辑:

提取共性:保留出现在两个及以上场景中的规则

去除个性:过滤仅属于特定需求的特殊逻辑

保留具体细节:避免笼统表述如“参考历史模板”,必须明确列出具体的验证点

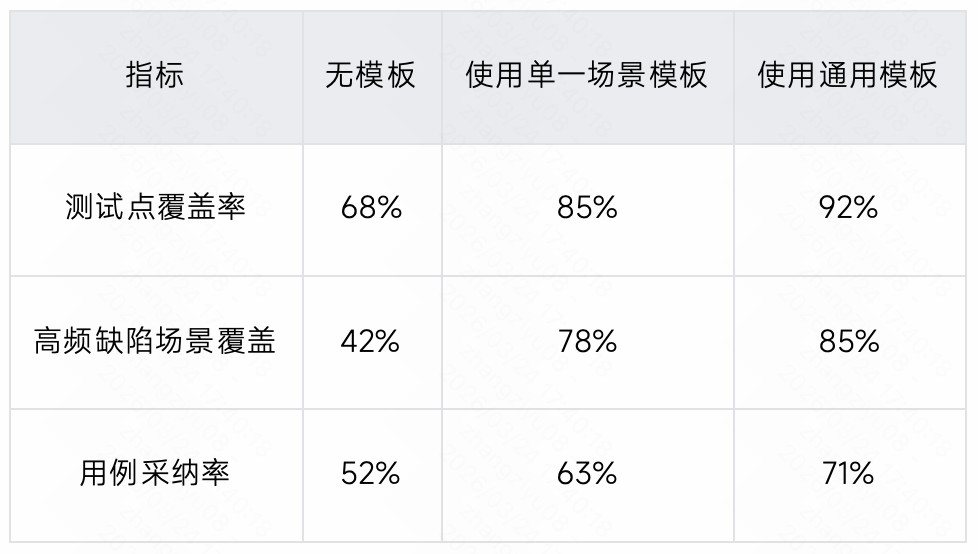

降低知识维护成本

提升生成质量

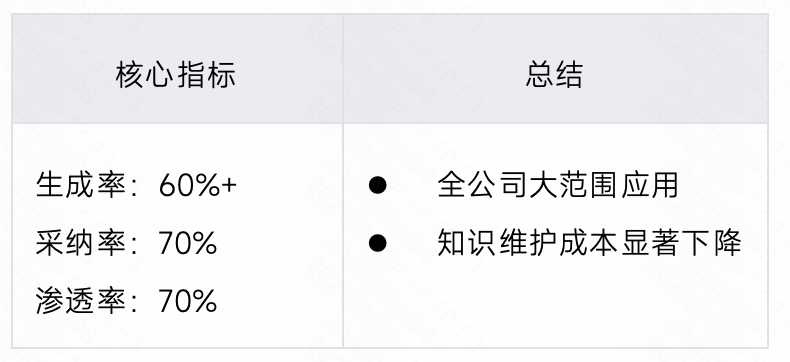

3.4.4 阶段总结

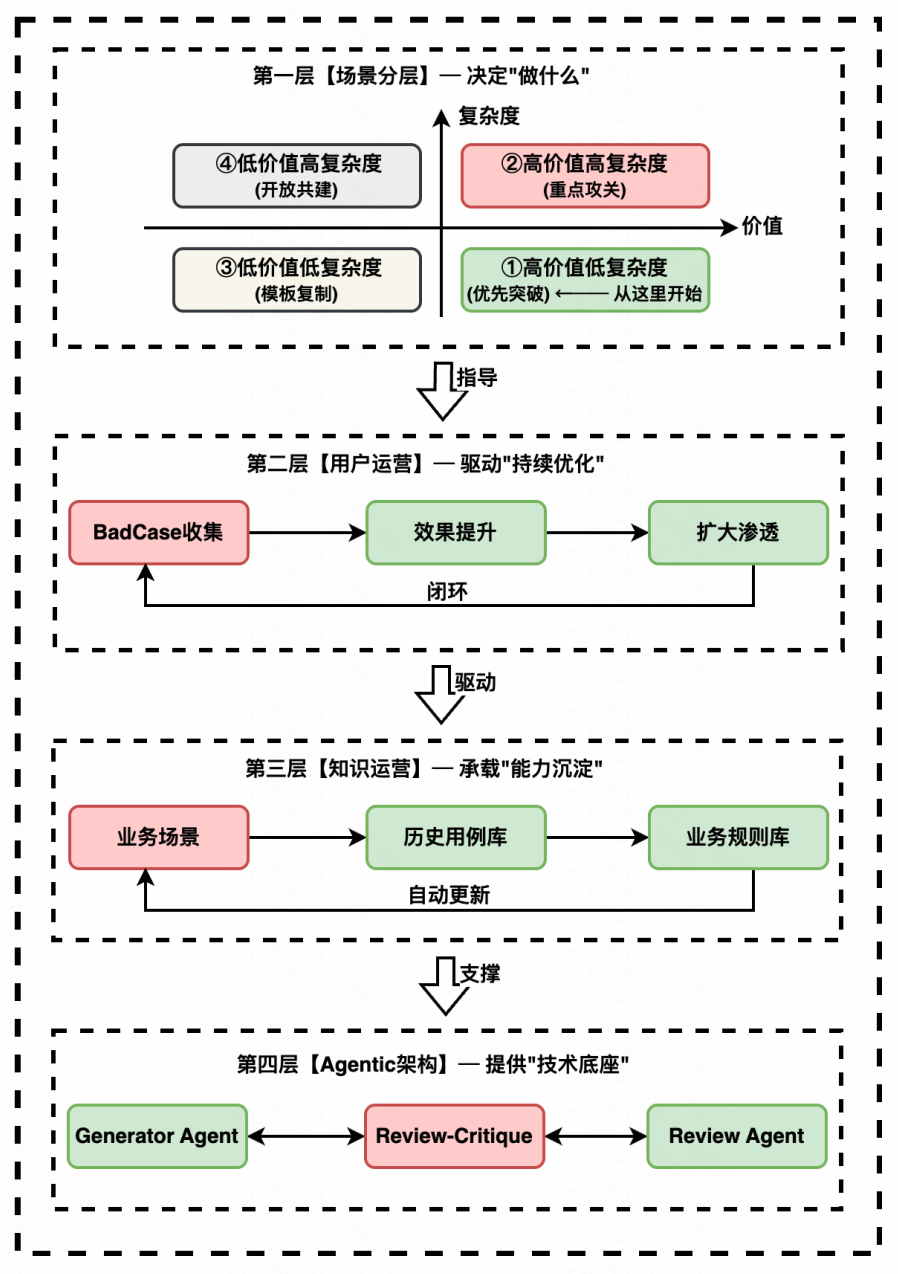

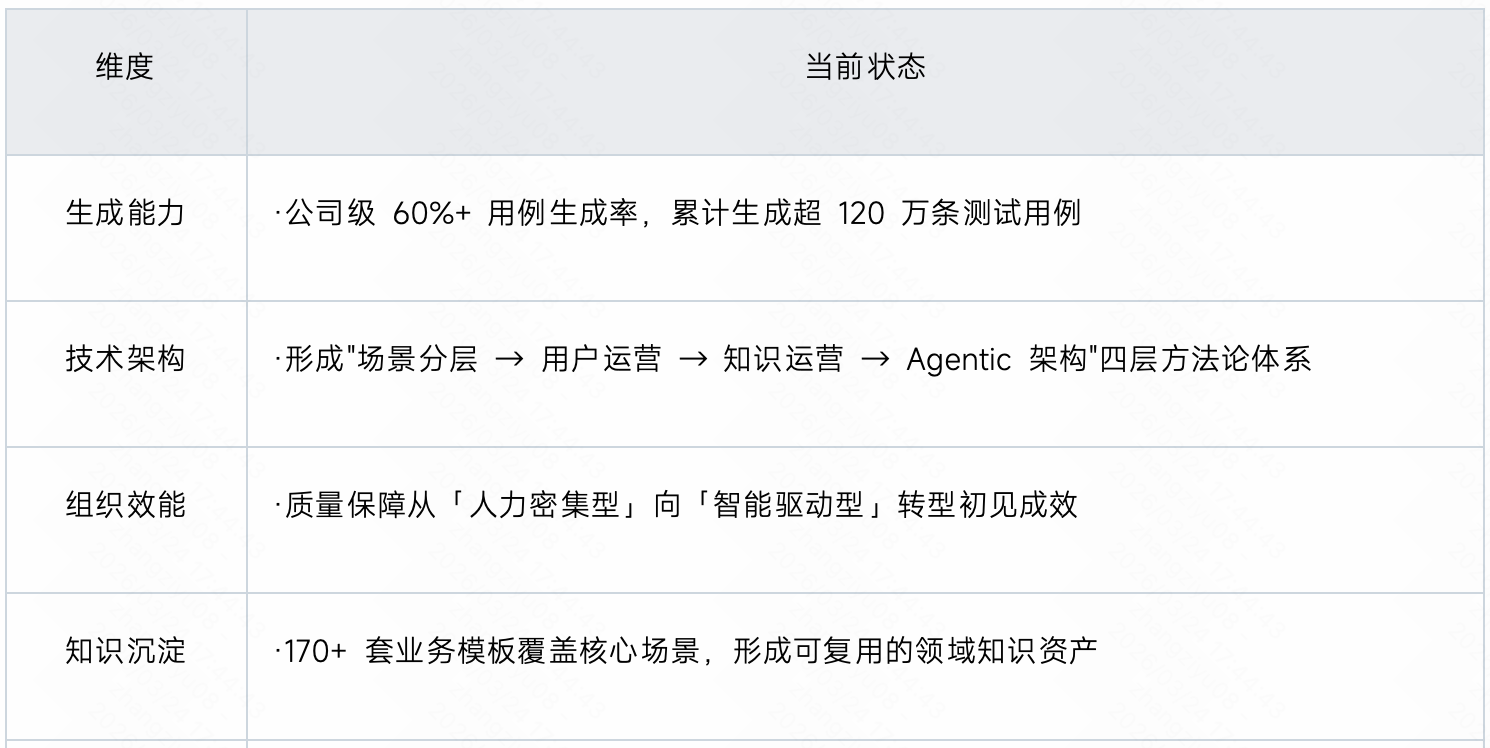

AI测试用例生成系统的成功,往往依赖于一套分层递进的架构体系。基于此,我们在实践中提炼出“四层架构”模型:场景分层 → 用户运营 → 知识运营 → Agentic架构,自上而下指导决策方向,自下向上提供能力支撑。

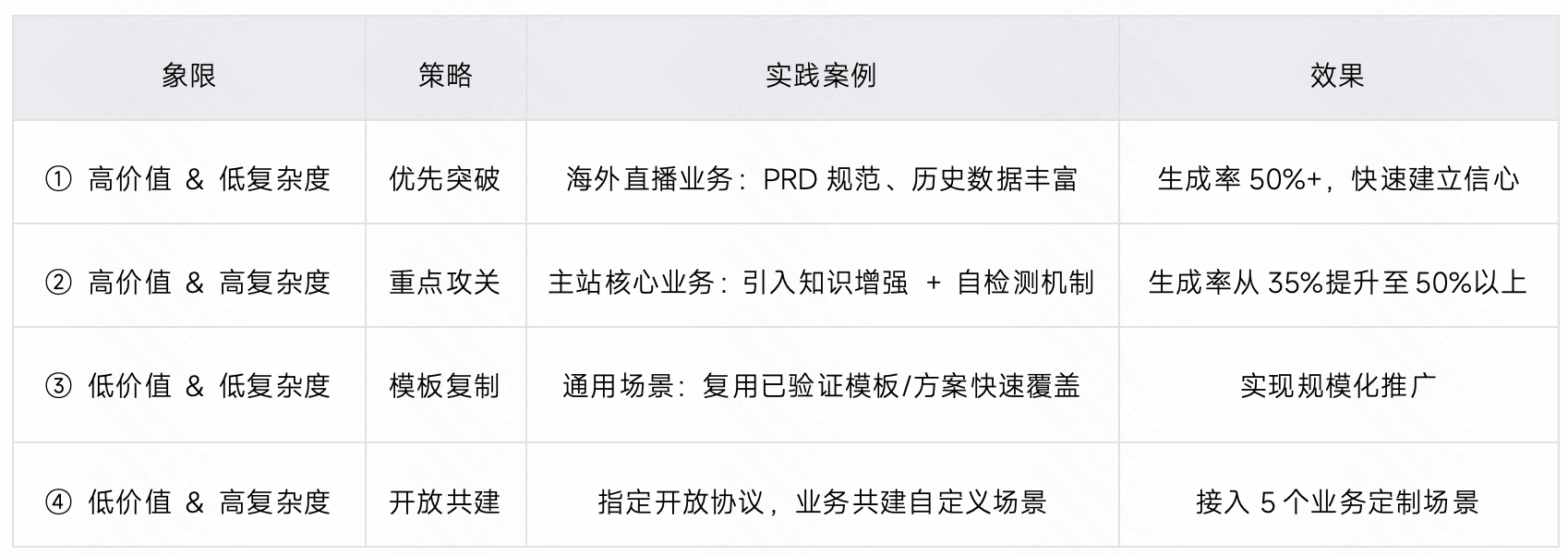

我们的核心原则是不追求“全覆盖”,而是基于价值x复杂度矩阵进行精准突破。

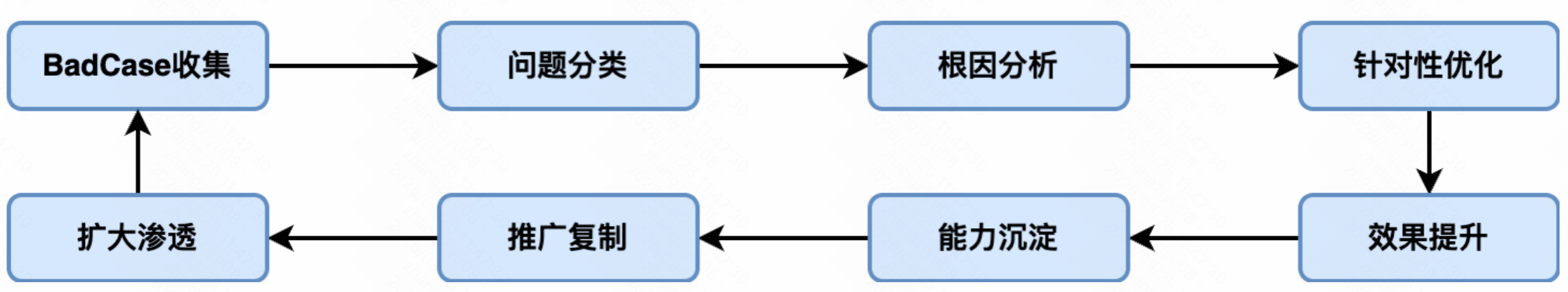

Badcase是最好的老师,通过系统化收集与分析用户反馈,驱动持续迭代优化。

闭环运营流程

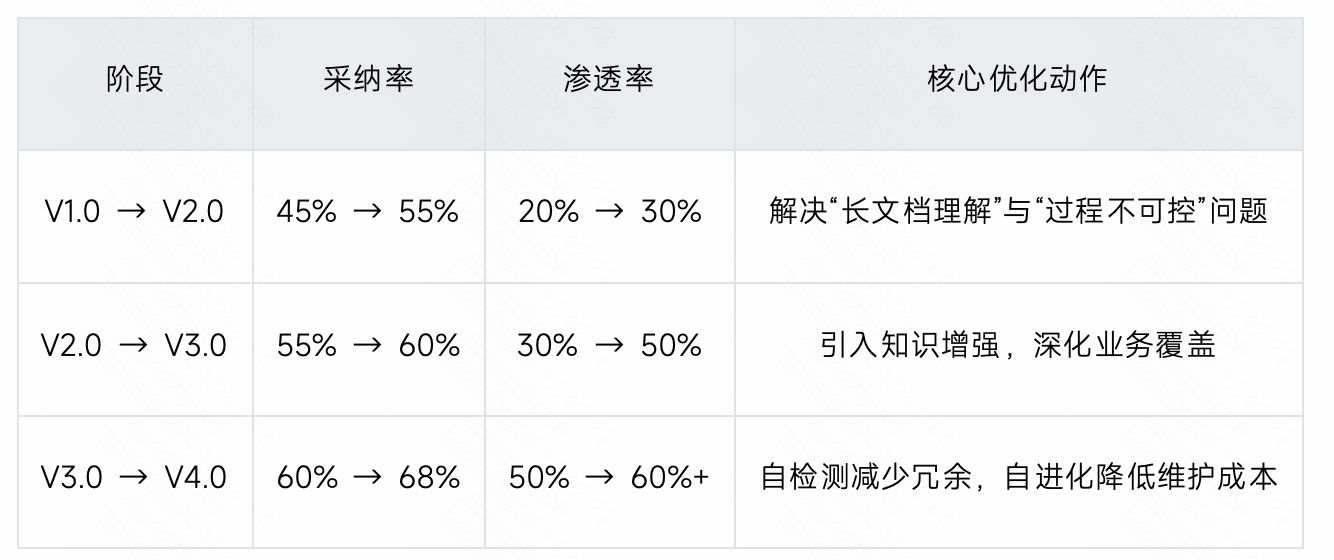

关键指标演进:

【触发】用户反馈:直播送礼场景缺少“并发送礼”测试点

【第一层 - 场景分层】

判定:直播送礼属于“高价值”场景,值得深入优化

【第二层 - 用户运营】

Badcase分类:覆盖类问题

根因分析:知识库缺少并发场景的历史缺陷数据

【第三层 - 知识运营】

补充缺陷库:新增“并发送礼重复扣款”历史Bug记录

更新规则库:提取“支付场景必须验证并发”规则

自动更新模板:直播送礼模板中新增并发测试点

【第四层 - Agentic架构】

RAG检索:后续生成自动召回并发相关知识

Critique Agent:自动检查是否覆盖并发场景

【结果】同类Badcase不再出现,场景覆盖率提升至92%

核心启示:

自顶向下做决策:通过场景分层明确资源投入方向,确保战略聚焦

自底向上建能力:以Agentic架构支撑知识运营,推动能力持续沉淀与复用

Badcase是进化燃料:每个问题都是优化契机,形成“反馈→改进→提升”的持续进化飞轮

经过从V1.0 到 V4.0的持续演进,快手智能测试用例生成系统已完成了从「实验性工具」到「标准化生产力工具」的跨越。

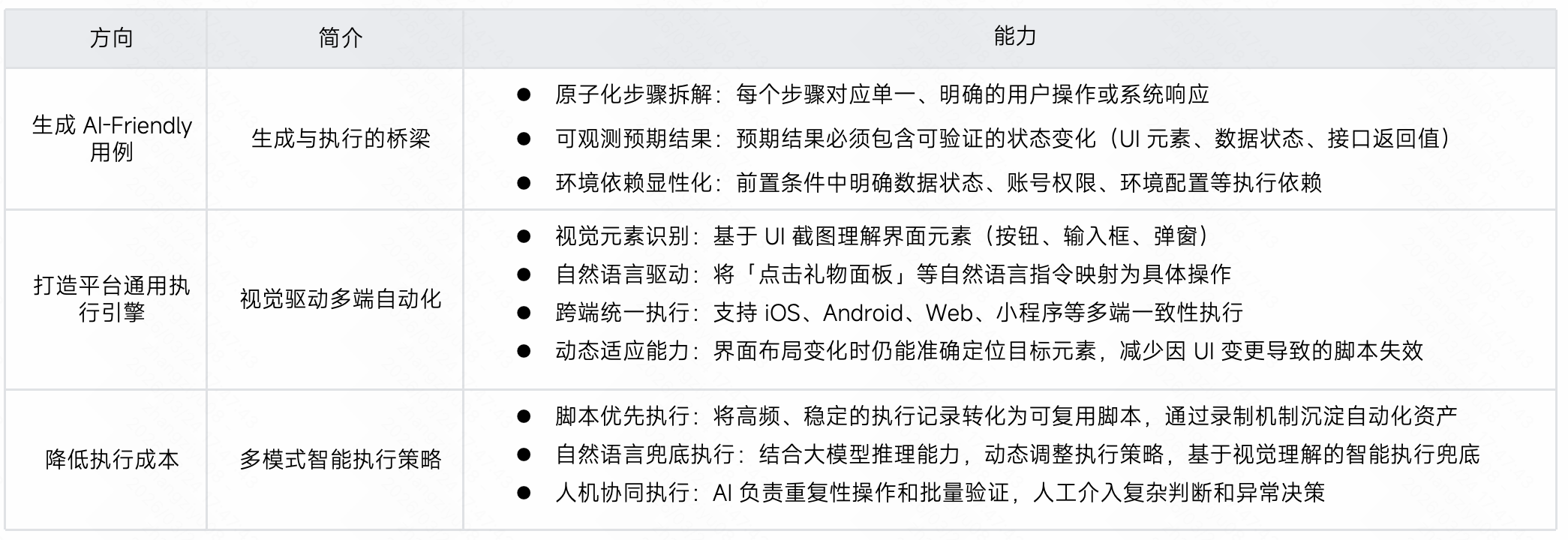

然而,我们也认识到,测试效率提升空间远不止于「生成」环节,测试人员仍需投入大量时间在手工用例执行上,这是下一阶段的核心突破方向。未来,我们将核心突破聚焦于「AI 智能执行用例」场景,构建从用例生成到用例执行的全链路智能化能力。

具体包含如下三个方向:

下一站